Cloud 变更日志 - 2024

2024年12月20日

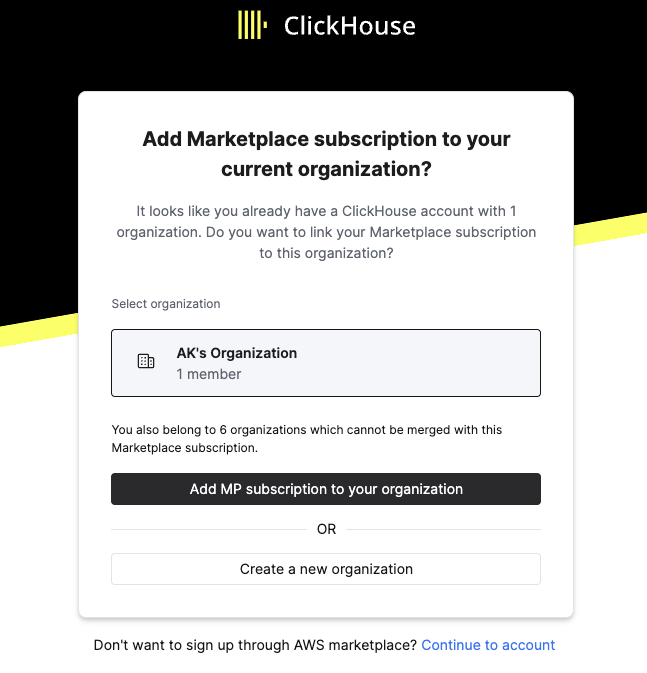

Marketplace 订阅与组织关联

您现在可以将新的 Marketplace 订阅关联到现有的 ClickHouse Cloud 组织。完成 Marketplace 订阅并跳转到 ClickHouse Cloud 后,您可以将之前创建的组织连接到新的 Marketplace 订阅。从此时起,组织中的资源将通过 Marketplace 计费。

强制设置 OpenAPI 密钥过期时间

现在可以限制 API 密钥的有效期选项,以避免创建永不过期的 OpenAPI 密钥。请联系 ClickHouse Cloud 支持团队,为您的组织启用这些限制。

通知的自定义邮箱地址

组织管理员现在可以为特定通知添加更多邮箱地址作为额外收件人。如果你希望将通知发送到别名地址,或发送给组织内其他并非 ClickHouse Cloud 用户的人员,这一功能会很有用。要进行配置,请在 Cloud Console 中进入通知设置,然后编辑要接收邮件通知的邮箱地址。

2024年12月6日

BYOC (Beta)

面向 AWS 的自带云环境现已进入 Beta 阶段。该部署模式允许您在自己的 AWS 账户中部署并运行 ClickHouse Cloud。我们目前支持在 11 个以上的 AWS 区域部署,且很快会支持更多区域。如需获取访问权限,请联系支持团队。请注意,该部署模式仅面向大规模部署。

ClickPipes 中的 Postgres 变更数据捕获 (CDC) 连接器

这一开箱即用的集成让用户只需点击几次,即可将 Postgres 数据库复制到 ClickHouse Cloud,并借助 ClickHouse 实现高速分析。您可以使用此连接器进行持续复制,也可以执行从 Postgres 到 ClickHouse Cloud 的一次性迁移。

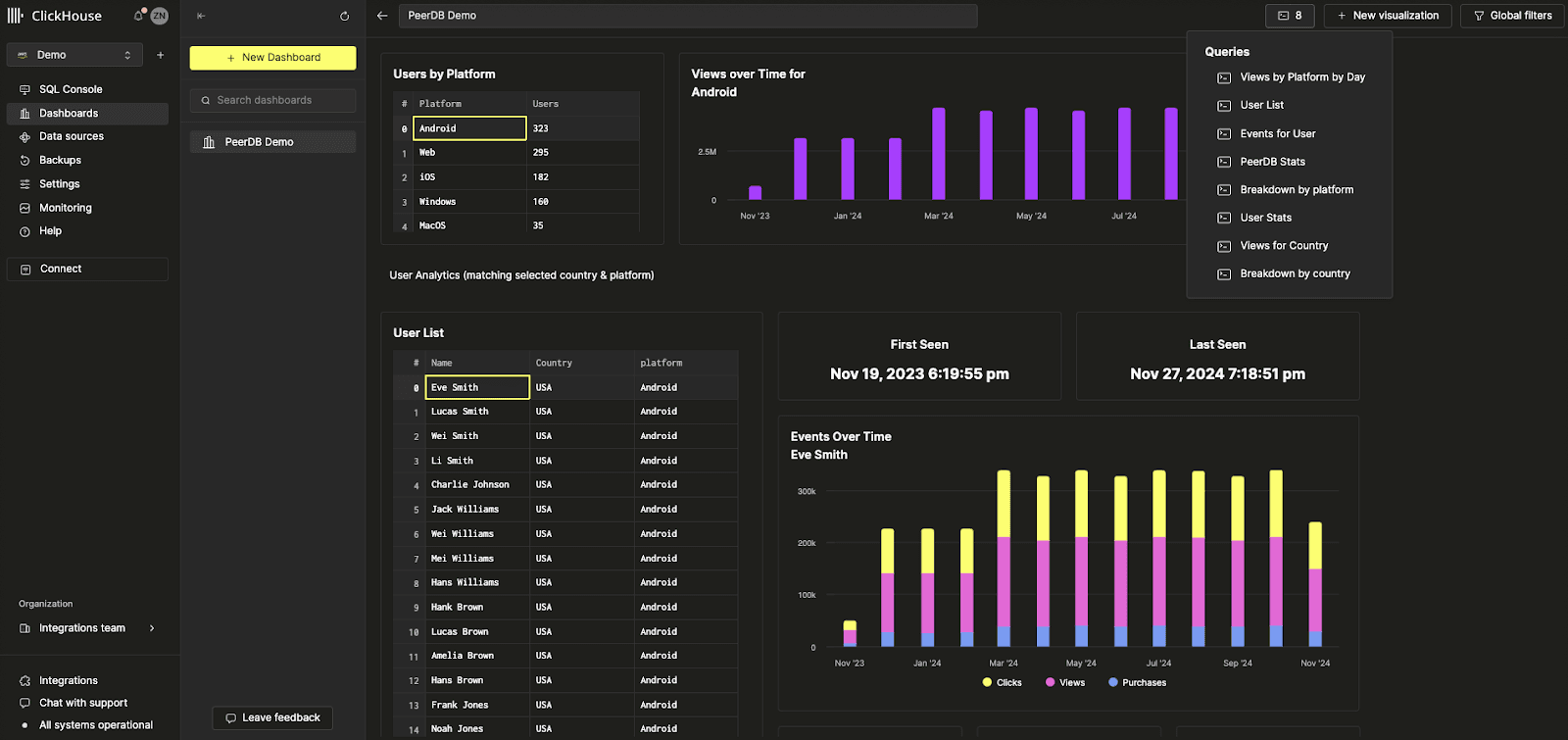

仪表板 (Beta)

本周,我们很高兴宣布 ClickHouse Cloud 中的仪表板功能正式进入 Beta 阶段。借助仪表板,您可以将已保存的查询转换为可视化内容,将这些可视化组织到仪表板中,并通过查询参数与仪表板交互。要上手,请参阅仪表板文档。

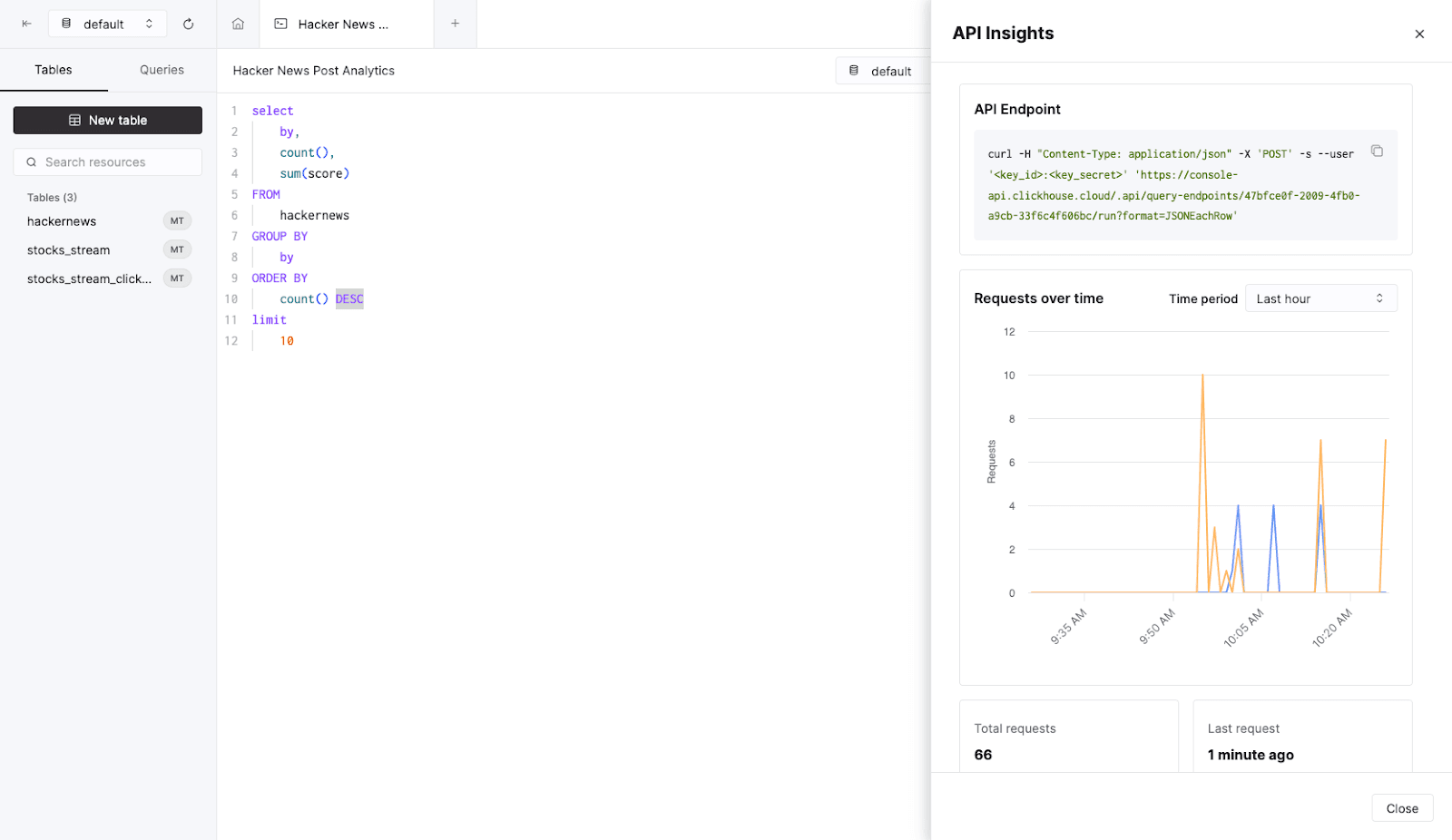

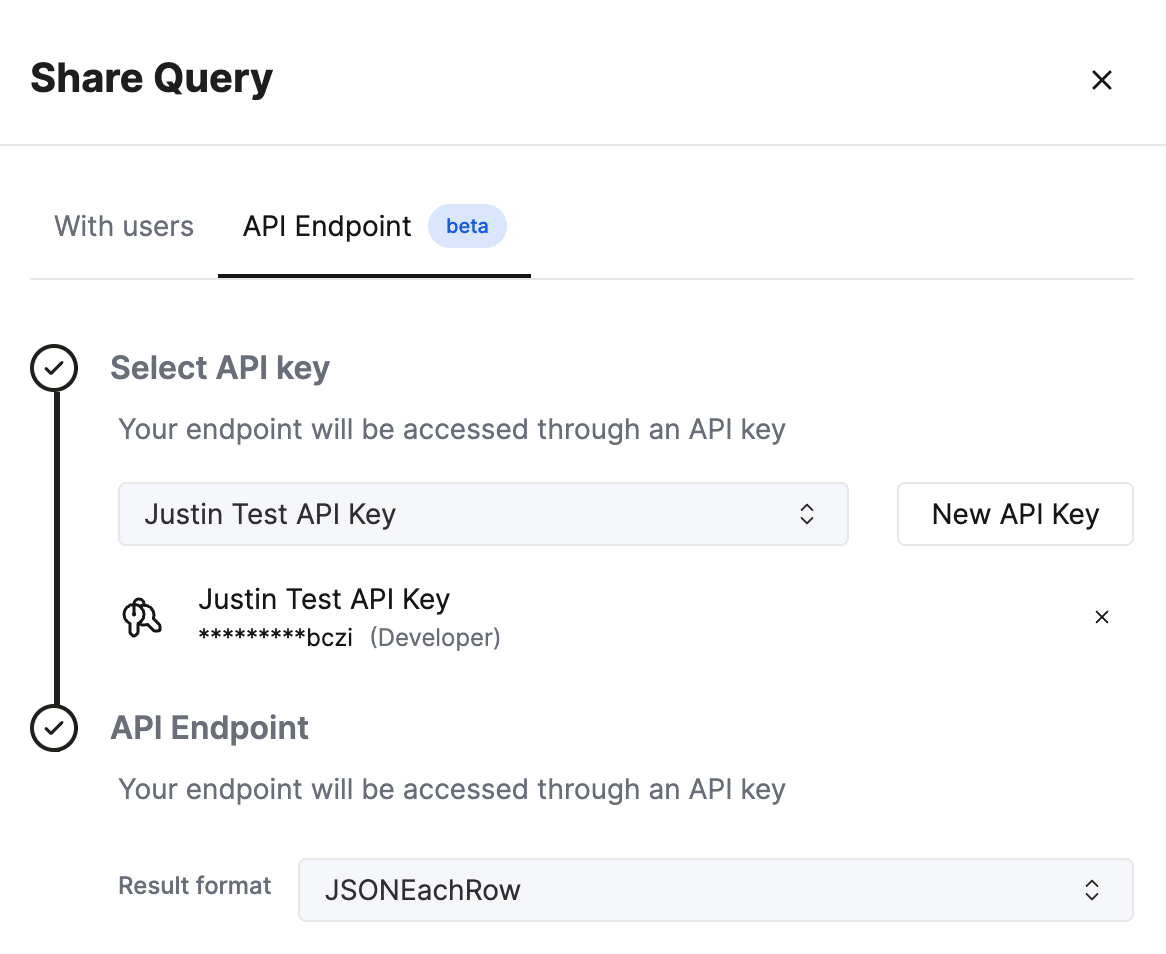

Query API Endpoints (GA)

我们很高兴地宣布,ClickHouse Cloud 中的 Query API Endpoints 已正式发布。借助 Query API Endpoints,您只需点击几下,即可为已保存的查询快速创建 RESTful API 端点,并在应用中开始使用数据,无需再处理各种语言客户端或复杂的身份验证。自首次推出以来,我们已发布多项改进,包括:

- 降低端点延迟,尤其是在冷启动场景下

- 增强端点的 RBAC 控制

- 可配置 CORS 允许的域名

- 结果流式传输

- 支持所有与 ClickHouse 兼容的输出格式

除上述改进外,我们还很高兴地宣布推出通用查询 API 端点。它基于我们现有的框架,让您能够针对 ClickHouse Cloud 服务执行任意 SQL 查询。通用端点可在服务设置页面启用和配置。

要上手,请参阅 Query API Endpoints 文档。

原生 JSON 支持 (Beta)

我们已在 ClickHouse Cloud 中推出原生 JSON 支持 Beta 版。要上手,请联系支持团队为您的 Cloud 服务启用该功能。

借助向量相似性索引进行向量搜索 (早期访问)

我们现宣布推出适用于近似向量搜索的向量相似性索引,现已开放早期访问。

ClickHouse 已经为向量相关应用场景提供了强大支持,包括丰富的[距离函数]https://clickhouse.com/blog/reinvent-2024-product-announcements#vector-search-using-vector-similarity-indexes-early-access)以及执行线性扫描的能力。此外,最近我们还新增了一种实验性的[近似向量搜索](/engines/table-engines/mergetree-family/annindexes)方法,由 usearch 库和分层可导航小世界 (HNSW) 近似最近邻搜索算法提供支持。

要上手,请加入早期访问候补名单。

ClickHouse-connect (Python) 和 ClickHouse Kafka Connect 用户

我们已向曾遇到相关问题的客户发送通知邮件;在这些问题中,客户端可能会遇到 MEMORY_LIMIT_EXCEEDED 异常。

请升级到:

- Kafka-Connect: > 1.2.5

- ClickHouse-Connect (Java): > 0.8.6

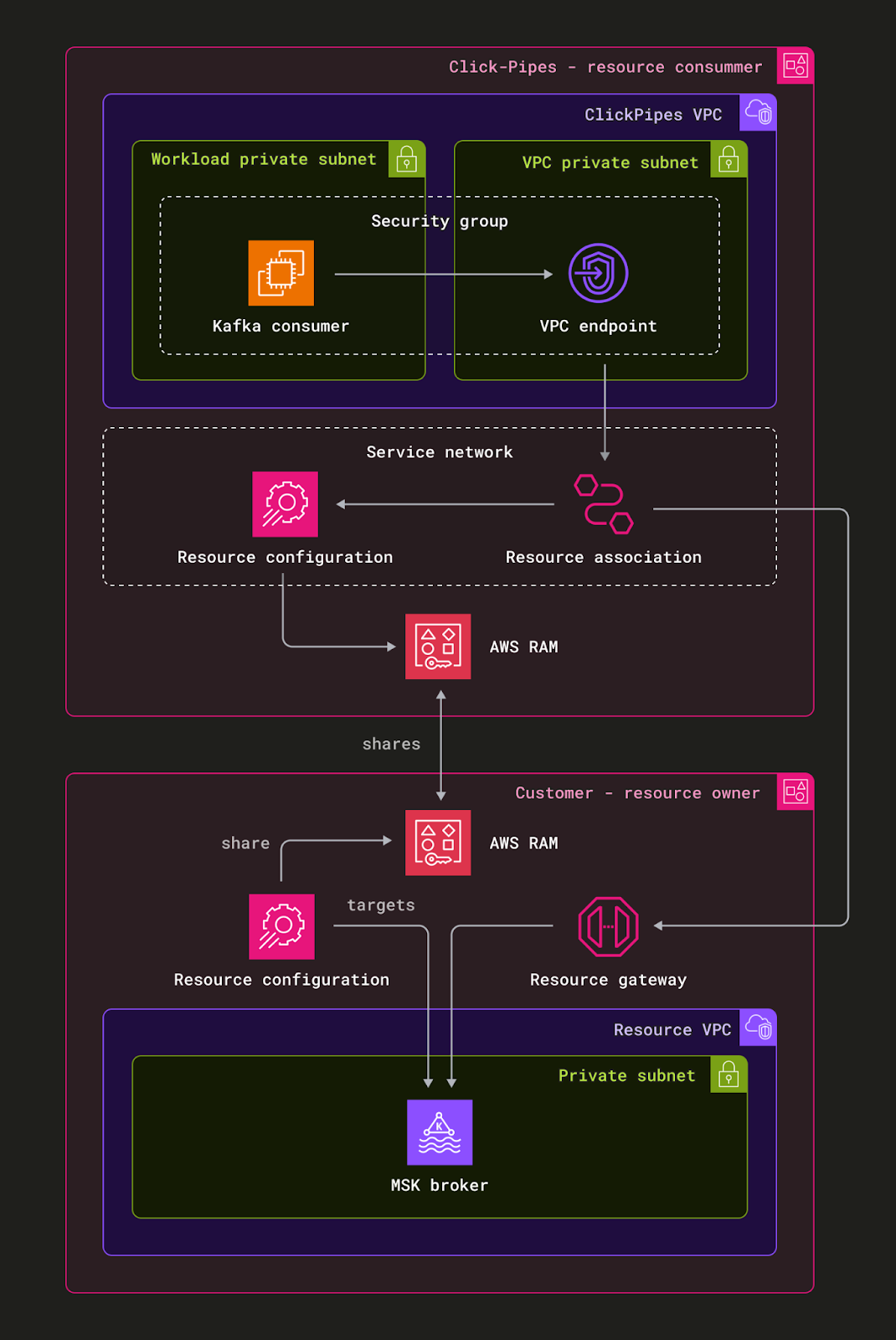

ClickPipes 现已支持在 AWS 上进行跨 VPC 资源访问

您现在可以向 AWS MSK 等特定数据源授予单向访问权限。借助基于 AWS PrivateLink 和 VPC Lattice 的跨 VPC 资源访问,您可以跨 VPC 和账户边界共享单个资源,甚至可以从本地网络进行共享;即使经过公共网络,也不会影响隐私性和安全性。要上手并搭建资源共享,您可以阅读这篇公告文章。

ClickPipes 现已支持 AWS MSK 的 IAM 身份验证

您现在可以在 AWS MSK ClickPipes 中使用 IAM 身份验证连接到 MSK Broker。要上手,请参阅我们的文档。

AWS 上新服务的最大副本大小

即日起,在 AWS 上创建的任何新服务,其可用的最大副本大小均为 236 GiB。

2024年11月22日

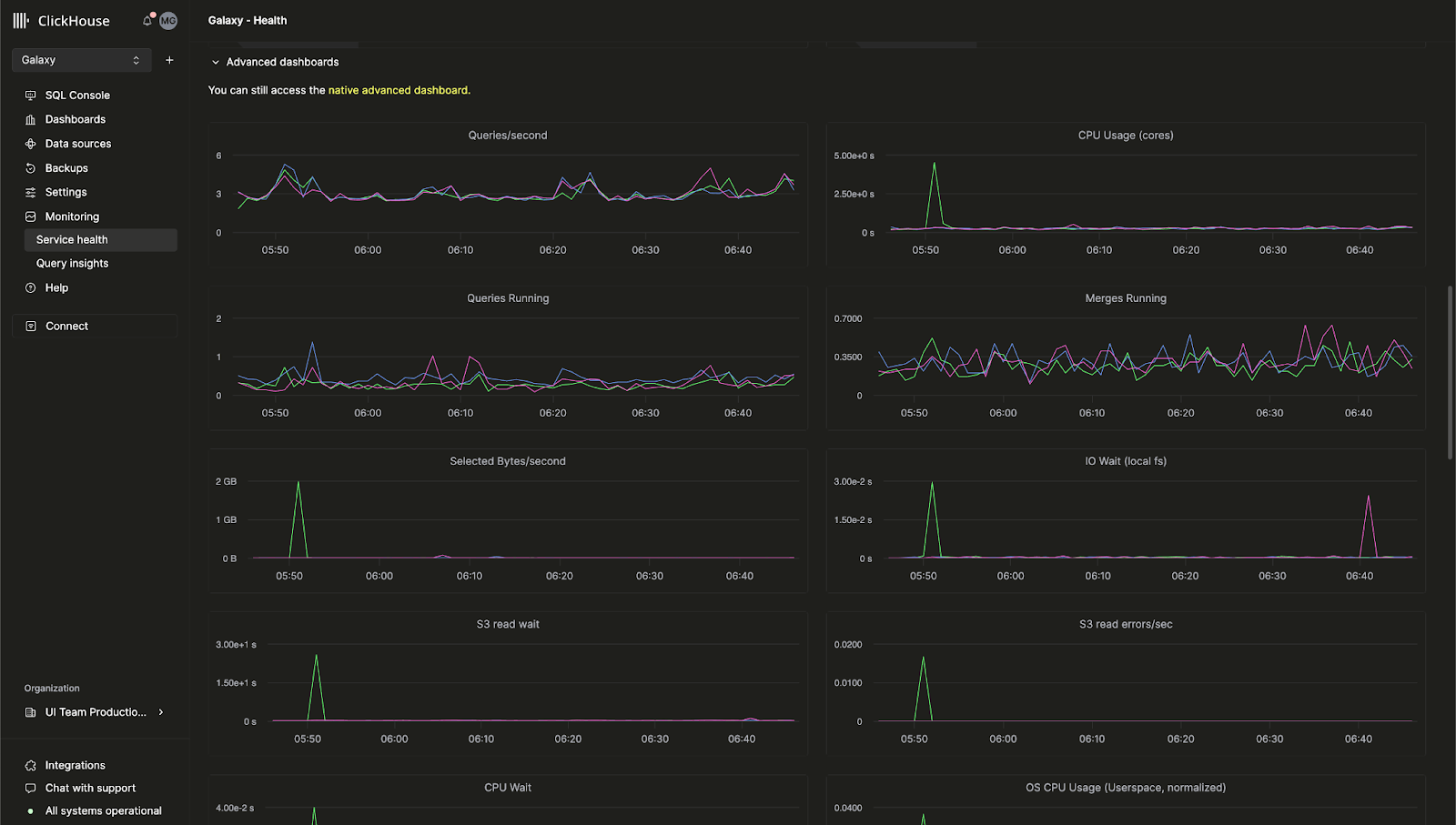

ClickHouse Cloud 内置进阶可观测性仪表板

此前,可用于监控 ClickHouse 服务端指标和硬件资源利用率的进阶可观测性仪表板仅在开源 ClickHouse 中提供。我们很高兴地宣布,这项功能现已在 ClickHouse Cloud 控制台中推出。

此仪表板让您可以在一体化 UI 中查看基于 system.dashboards 表的查询。访问 Monitoring > 服务健康 页面,即可立即开始使用进阶可观测性仪表板。

AI 驱动的 SQL 自动补全

我们显著增强了自动补全功能。借助全新的 AI Copilot,您在编写查询时可获得内联 SQL 补全建议。对于任何 ClickHouse Cloud 服务,只需切换 "启用内联代码补全" 设置即可启用此功能。

新增“Billing”角色

您现在可以将组织中的用户分配为新的 Billing 角色,使其能够查看和管理账单信息,而无需授予其配置或管理服务的权限。只需邀请新用户,或编辑现有用户的角色,即可分配 Billing 角色。

2024 年 11 月 8 日

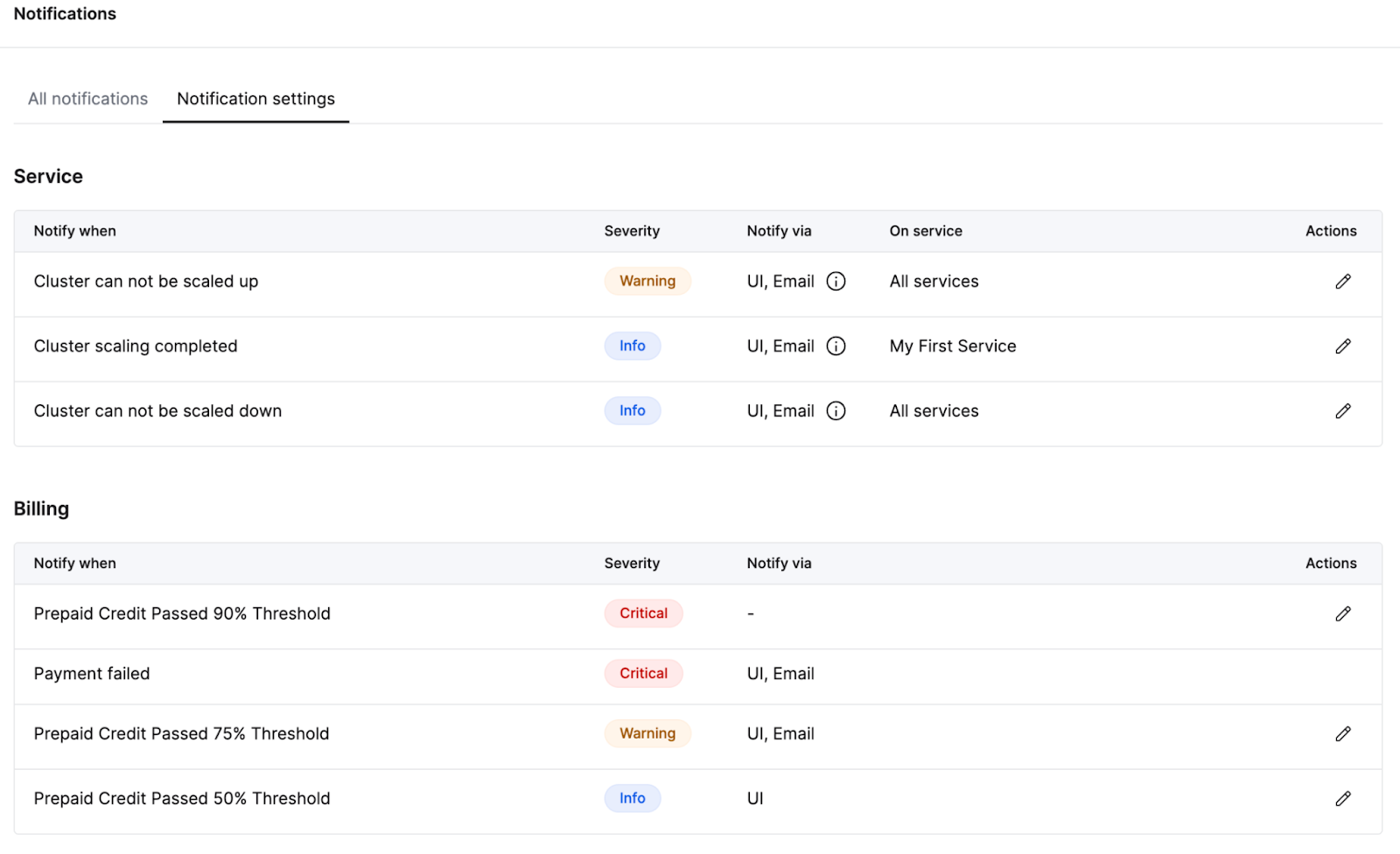

ClickHouse Cloud 中的客户通知

ClickHouse Cloud 现已针对多种计费和扩缩容事件提供控制台内通知和电子邮件通知。客户可以通过 Cloud Console 的通知中心配置这些通知,仅在界面中显示、通过电子邮件接收,或同时采用这两种方式。您还可以在服务级别配置所接收通知的类别和严重程度。

未来,我们还将为其他事件添加通知,并提供更多接收通知的方式。

请参阅 ClickHouse 文档,详细了解如何为您的服务启用通知。

2024年10月4日

ClickHouse Cloud 现已在 GCP 为 HIPAA 就绪服务提供 Beta 支持

希望为受保护健康信息 (PHI) 提供更高安全性的客户,现可在 Google Cloud Platform (GCP) 上开通 ClickHouse Cloud。ClickHouse 已实施 HIPAA Security Rule 规定的管理、物理和技术保障措施,并提供可配置的安全设置,可根据您的具体用例和工作负载进行配置。如需了解可用安全设置的更多信息,请参阅我们的安全功能页面。

该服务目前在 GCP us-central-1 区域向使用 Dedicated 服务类型的客户提供,且需要签署 Business Associate Agreement (BAA)。如需申请使用此功能,或加入更多 GCP、AWS 和 Azure 区域的等候名单,请联系销售团队或支持团队。

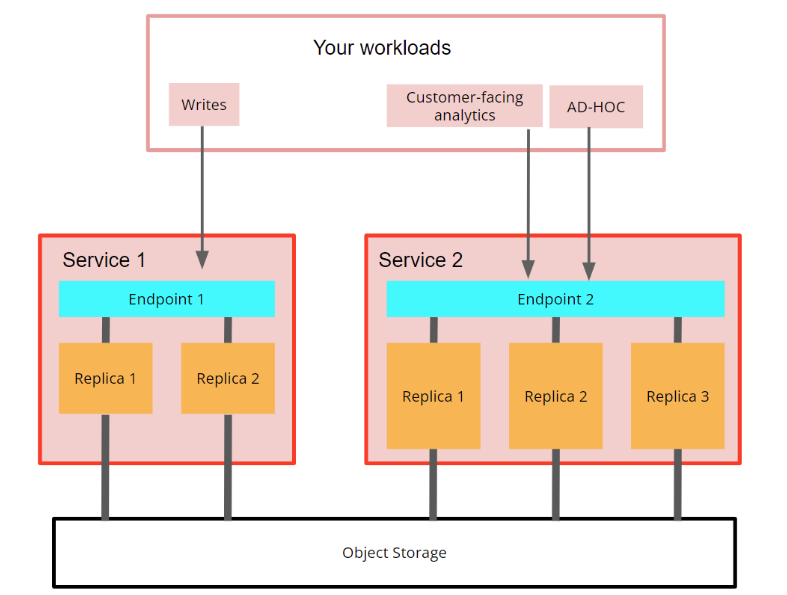

Compute-compute separation 现已在 GCP 和 Azure 上开放私有预览

我们最近宣布,AWS 已开放 Compute-Compute Separation 的私有预览。现在,我们很高兴地宣布,该功能也已在 GCP 和 Azure 上推出。

Compute-compute separation 允许您将特定服务指定为读写服务或只读服务,从而为应用程序设计出最佳的计算配置,以优化成本和性能。更多详情,请参阅文档。

自助式 MFA 恢复代码

使用多因素身份验证的客户现在可以获取恢复代码,以便在手机丢失或 MFA 令牌被意外删除时使用。首次启用 MFA 的客户会在设置过程中获得该代码。已启用 MFA 的客户可以通过移除现有的 MFA 令牌并添加新的令牌来获取恢复代码。

ClickPipes 更新:自定义证书、延迟洞察等。

我们很高兴分享 ClickPipes 的最新更新。作为将数据摄取到 ClickHouse 服务的最简便方式,ClickPipes 此次新增的功能可帮助您更好地控制数据摄取过程,并更清晰地了解性能指标。

Kafka 的自定义身份验证证书

ClickPipes for Kafka 现已支持为使用 SASL 和公共 SSL/TLS 的 Kafka broker 配置自定义身份验证证书。您可以在设置 ClickPipe 时,通过 SSL Certificate 部分轻松上传自己的证书,从而确保与 Kafka 建立更安全的连接。

推出 Kafka 和 Kinesis 的延迟指标

性能可观测性至关重要。ClickPipes 现在提供延迟图表,让您了解从消息生成 (无论来自 Kafka Topic 还是 Kinesis Stream) 到在 ClickHouse Cloud 中完成摄取之间的时间间隔。借助这一新指标,您可以更密切地关注数据管道的性能,并据此进行优化。

Kafka 和 Kinesis 的扩缩容控制 (私有 Beta)

高处理量可能需要额外资源来满足您的数据量和延迟需求。我们正在为 ClickPipes 推出水平扩缩容功能,并可直接通过Cloud Console使用。该功能目前处于私有 Beta 阶段,让您能够根据自身需求更高效地扩展资源。请联系 support 加入 Beta。

Kafka 和 Kinesis 的原始消息摄取

现在,您可以在不解析消息的情况下,直接摄取整条 Kafka 或 Kinesis 消息。ClickPipes 现已支持 _raw_message 虚拟列,允许用户将完整消息映射到单个 String 列中。这使您能够根据需要灵活处理原始数据。

2024 年 8 月 29 日

新版 Terraform 提供程序 - v1.0.0

Terraform 让您能够以编程方式管理 ClickHouse Cloud 服务,并将配置以代码形式存储。我们的 Terraform 提供程序下载量已接近 200,000 次,现已正式发布 v1.0.0。该新版本包含多项改进,例如更完善的重试逻辑,以及一个可将私有端点附加到 ClickHouse Cloud 服务的新资源。您可以在此处下载 Terraform 提供程序,并在此处查看完整更新日志。

2024 年 SOC 2 Type II 报告和更新版 ISO 27001 证书

我们很高兴地宣布,2024 年 SOC 2 Type II 报告和更新版 ISO 27001 证书现已发布。这两份文件均涵盖了我们最近在 Azure 上推出的服务,并继续覆盖 AWS 和 GCP 上的服务。

我们的 SOC 2 Type II 体现了我们持续致力于保障向 ClickHouse 用户提供的服务在安全性、可用性、处理完整性和保密性方面达到高标准。如需了解更多信息,请参阅美国注册会计师协会 (AICPA) 发布的 SOC 2 - SOC for Service Organizations: Trust Services Criteria 以及国际标准化组织 (ISO) 的 What is ISO/IEC 27001。

另请访问我们的 Trust Center,查看安全与合规相关文档及报告。

2024 年 8 月 15 日

Compute-compute separation 现已在 AWS 上进入私有预览

对于现有的 ClickHouse Cloud 服务,副本同时承担读写操作,且无法将某个特定副本配置为仅处理其中一种操作。我们即将推出一项名为 Compute-compute separation 的新功能,支持您将特定服务指定为读写服务或只读服务,从而为应用设计最优的计算配置,兼顾成本与性能。

借助新的 Compute-compute separation 功能,您可以创建多个计算节点组,每个节点组都有各自的端点,并使用同一个对象存储文件夹,因此共享相同的表、视图等。有关更多信息,请参阅此处的 Compute-compute separation。如果您希望在私有预览阶段使用此功能,请联系支持团队。

适用于 S3 和 GCS 的 ClickPipes 现已 GA,并支持连续模式

ClickPipes 是将数据摄取到 ClickHouse Cloud 的最简便方式。我们很高兴地宣布,适用于 S3 和 GCS 的 ClickPipes 现已正式可用。ClickPipes 同时支持一次性批次摄取和“连续模式”。摄取任务会将特定远程存储桶中匹配指定模式的所有文件加载到 ClickHouse 目标表中。在“连续模式”下,ClickPipes 作业会持续运行,在远程对象存储桶中有新的匹配文件到达时自动进行摄取。这样,您就可以将任何对象存储桶用作功能完备的数据摄取暂存区,将数据导入 ClickHouse Cloud。有关 ClickPipes 的更多信息,请参阅我们的文档。

2024 年 7 月 18 日

Prometheus 指标端点现已正式发布

在上一篇 Cloud 更新日志中,我们宣布了从 ClickHouse Cloud 导出 Prometheus 指标的私有预览功能。借助此功能,您可以使用 ClickHouse Cloud API 将指标接入 Grafana 和 Datadog 等工具进行可视化。我们很高兴地宣布,该功能现已正式可用。如需了解更多信息,请参阅我们的文档。

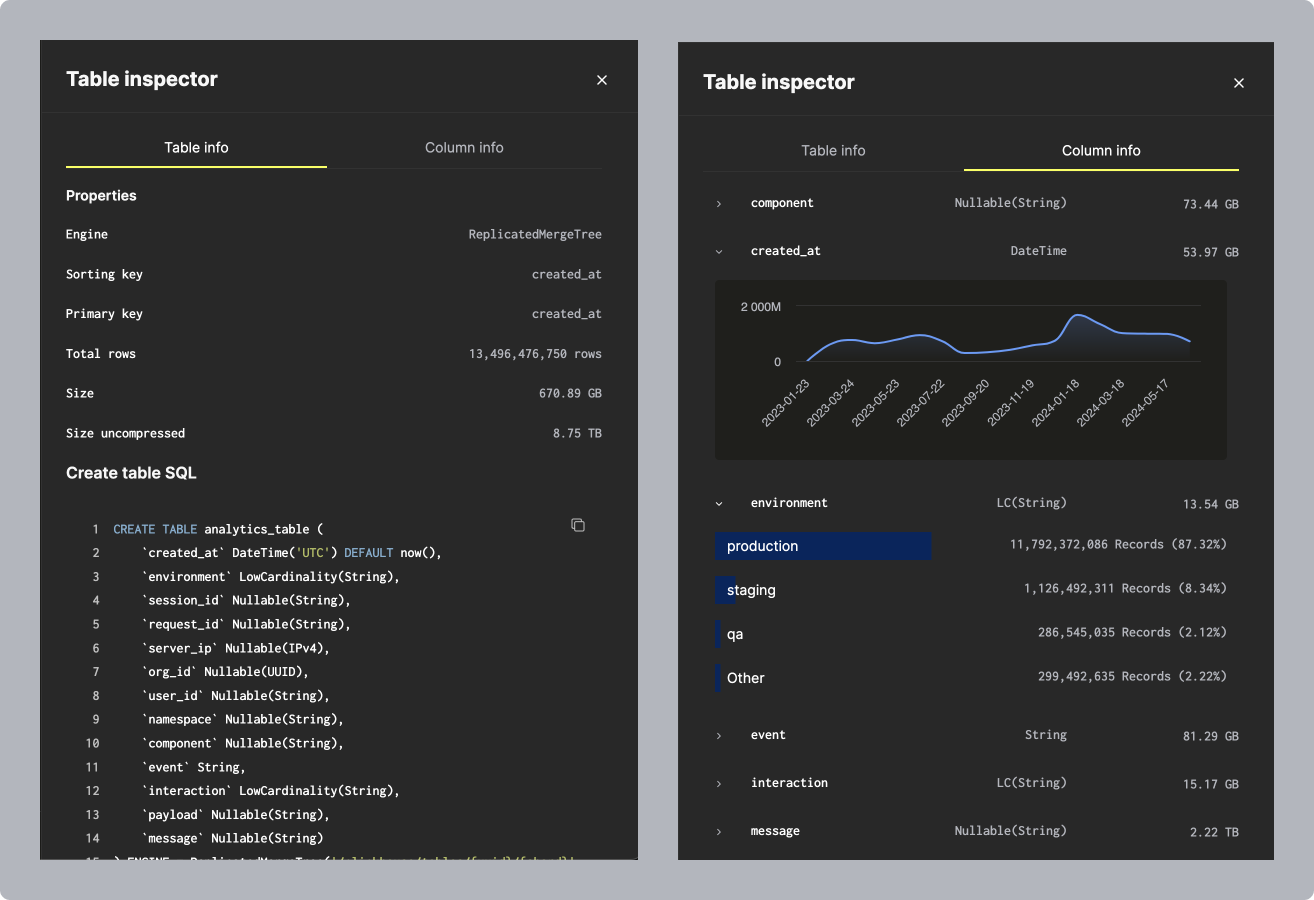

Cloud Console 中的表检查器

ClickHouse 提供了 DESCRIBE 等命令,可用于检查表并查看 schema。这些命令会将结果输出到控制台,但通常不太方便,因为要获取表和列的全部相关信息,往往需要组合多条查询。

我们最近在 Cloud Console 中推出了 Table Inspector,让您无需编写 SQL,即可直接在 UI 中查看重要的表和列信息。您可以前往 Cloud Console,为您的服务试用 Table Inspector。它在统一界面中集中展示 schema、存储、压缩等信息。

新版 Java 客户端 API

我们的 Java 客户端 是用户连接 ClickHouse 时最常用的客户端之一。我们希望让它更易用、更直观,为此重新设计了 API,并进行了多项性能优化。这些改进将让您从 Java 应用程序连接到 ClickHouse 变得更加轻松。您可以在这篇博客文章中进一步了解如何使用更新后的 Java 客户端。

新分析器现已默认启用

过去几年里,我们一直在开发一款用于查询解析和优化的新分析器。该分析器可提升查询性能,并为进一步优化奠定基础,包括实现更快、更高效的 JOIN。此前,新用户需要通过设置 allow_experimental_analyzer 来启用这项功能。现在,新的 ClickHouse Cloud 服务已默认启用这一改进后的分析器。

后续我们还将持续改进分析器,并推出更多优化,敬请关注。

2024年6月28日

面向 Microsoft Azure 的 ClickHouse Cloud 现已正式可用

我们早在今年 5 月就宣布了对 Microsoft Azure 的 Beta 支持。在这次最新的云版本发布中,我们很高兴地宣布,Azure 支持已从 Beta 过渡到正式可用。至此,ClickHouse Cloud 已可在三大主流云平台上使用:AWS、Google Cloud Platform,以及现在的 Microsoft Azure。

此次发布还支持通过 Microsoft Azure Marketplace 订阅。该服务初期将支持以下区域:

- 美国:West US 3 (Arizona)

- 美国:East US 2 (Virginia)

- 欧洲:Germany West Central (Frankfurt)

如果您希望支持某个特定区域,请联系我们。

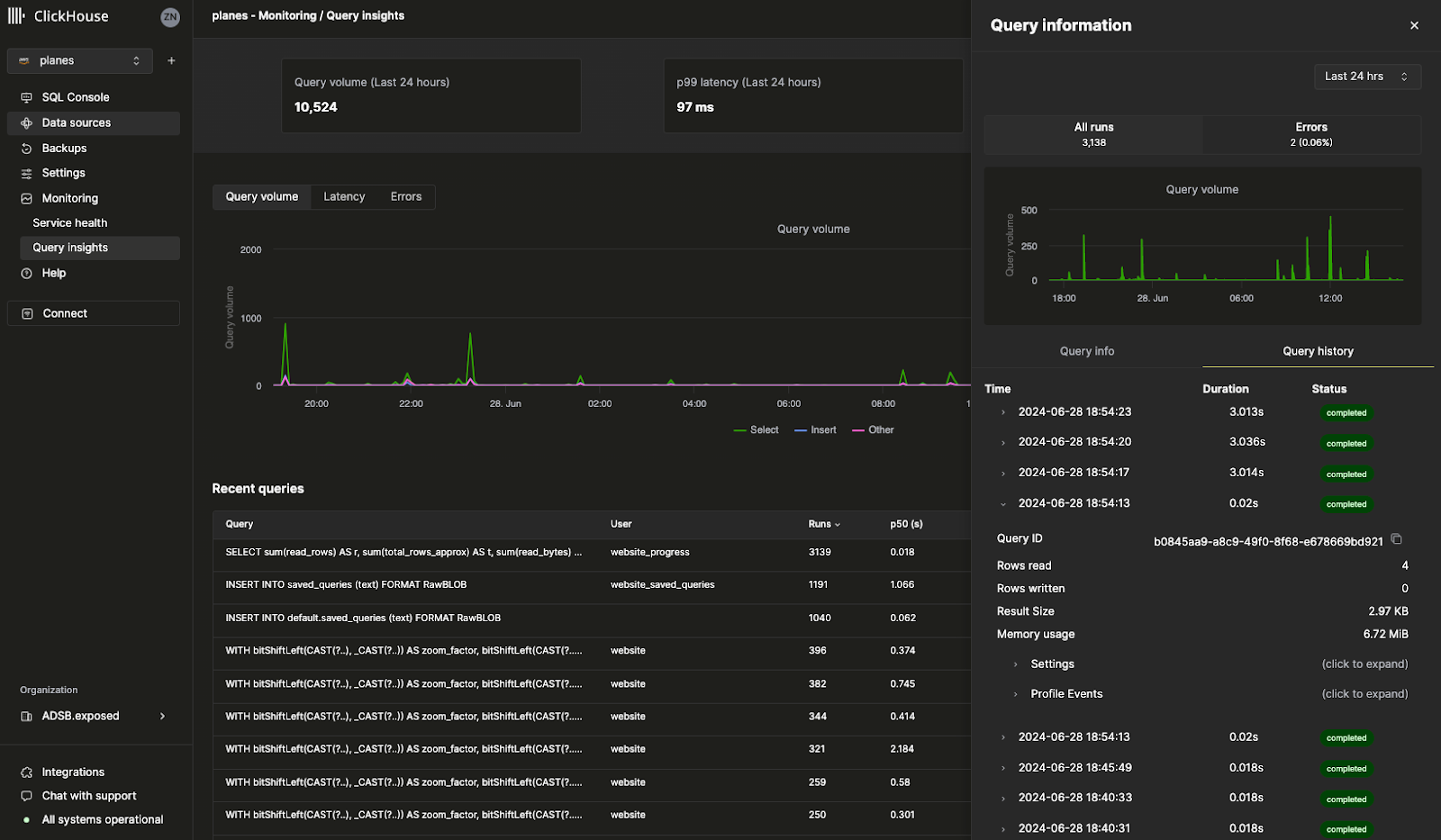

查询日志洞察

我们在 Cloud Console 中推出的全新 Query Insights UI,大幅降低了使用 ClickHouse 内置查询日志的门槛。ClickHouse 的 system.query_log 表是进行查询优化、调试以及监控整体集群健康状况和性能的关键信息来源。唯一需要注意的是:它包含 70 多个字段,且每个查询对应多条记录,因此理解查询日志有较高的学习门槛。这个查询洞察的初始版本为后续进一步简化查询调试和优化流程提供了蓝图。随着我们持续迭代这项功能,非常期待听到你的反馈,欢迎联系我们——你的意见对我们十分宝贵。

Prometheus 指标端点 (私有预览)

这可能是我们呼声最高的功能之一:现在,您可以将 ClickHouse Cloud 中的 Prometheus 指标导出到 Grafana 和 Datadog 进行可视化。Prometheus 提供了一种开源方案,可用于监控 ClickHouse 并设置自定义告警。您可以通过 ClickHouse Cloud API 访问您的 ClickHouse Cloud 服务的 Prometheus 指标。该功能目前处于私有预览阶段。请联系支持团队,为您的组织启用此功能。

其他功能

- 可配置备份 现已正式可用,可用于自定义备份策略,例如备份频率、保留期和计划。

2024 年 6 月 13 日

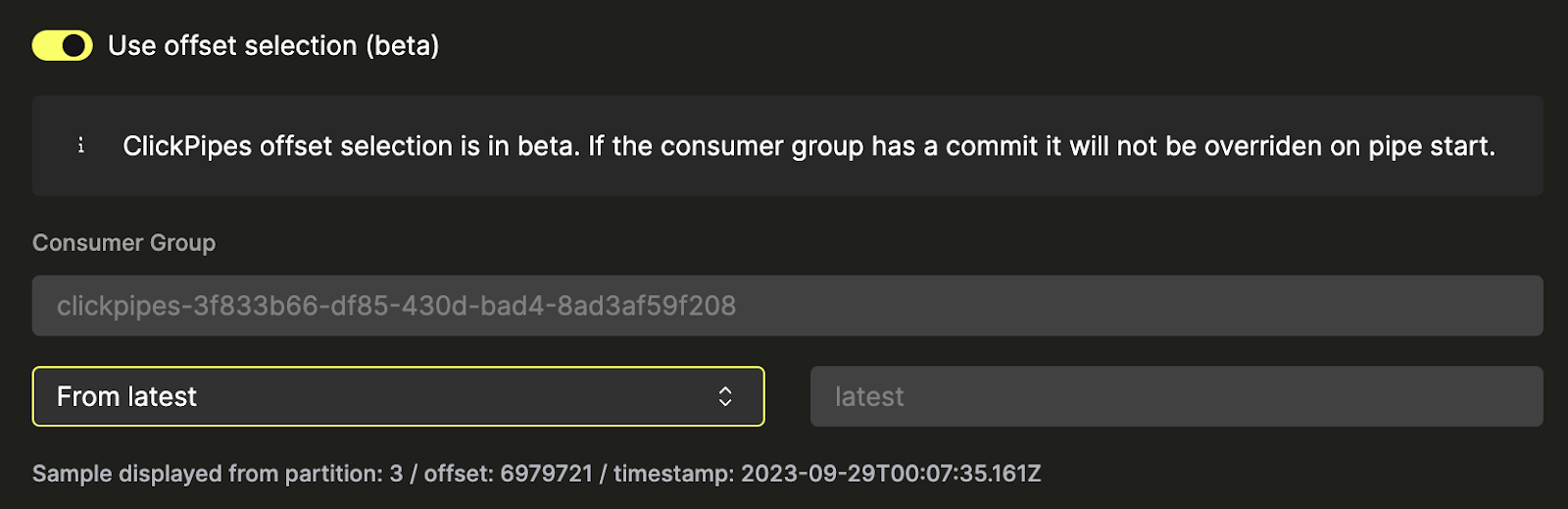

Kafka ClickPipes Connector 的可配置消费偏移量 (Beta)

直到最近,每当您搭建新的 用于 ClickPipes 的 Kafka Connector 时,它始终都会从 Kafka topic 的开头开始消费数据。在需要重新处理历史数据、监控新写入的数据,或从某个精确位置恢复时,这种行为可能不够灵活,难以满足特定使用场景。

ClickPipes for Kafka 新增了一项功能,进一步提升了从 Kafka topic 消费数据时的灵活性和控制力。您现在可以配置从哪个偏移量开始消费数据。

可用选项如下:

- 从开头开始:从 Kafka topic 的最开始位置消费数据。如果您需要重新处理全部历史数据,此选项非常适合。

- 从最新位置开始:从最新偏移量开始消费数据。如果您只关注新消息,这个选项很有用。

- 从时间戳开始:从在特定时间戳或之后产生的消息开始消费数据。此功能可提供更精细的控制,使您能够从某个精确时间点恢复处理。

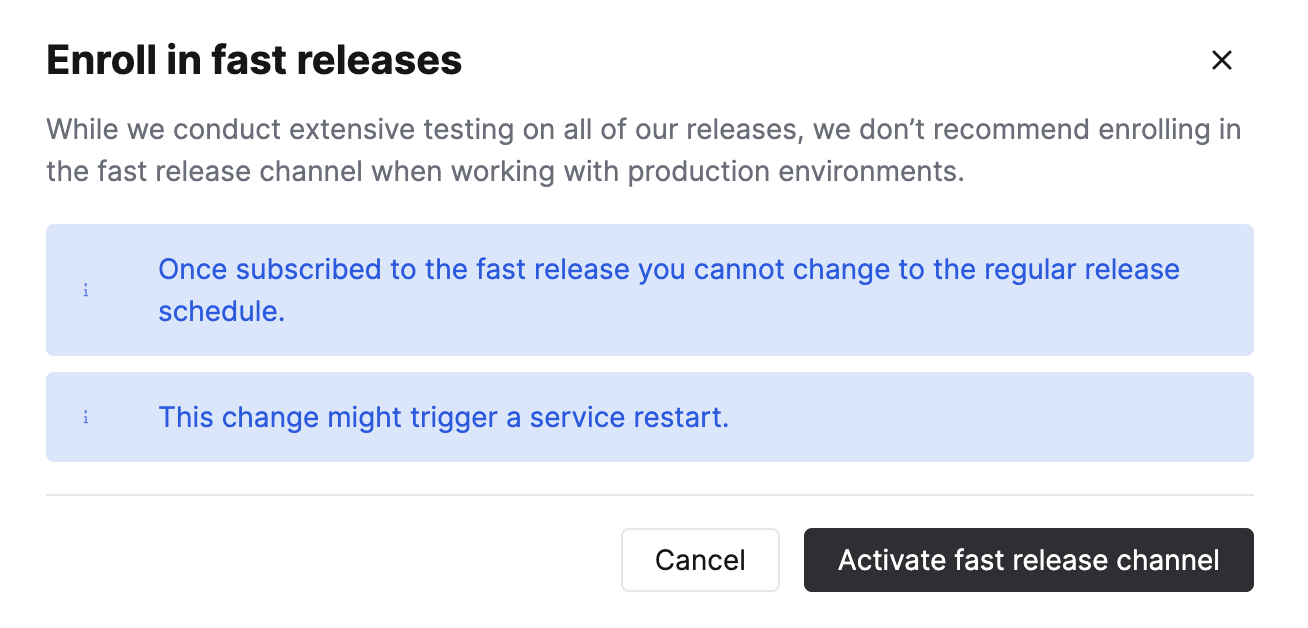

将服务加入 빠른 릴리스 채널

빠른 릴리스 채널可让您的服务在发布计划之前接收更新。此前,启用此功能需要支持团队协助。现在,您可以直接通过 ClickHouse Cloud 控制台为您的服务启用此功能。只需前往 设置,然后点击 加入快速发布。此后,您的服务将在更新可用时立即接收更新。

Terraform 对水平扩缩容的支持

ClickHouse Cloud 支持水平扩缩容,即为您的服务添加更多相同规格的副本。水平扩缩容可提升性能和并行处理能力,以支持并发查询。此前,若要添加更多副本,需要使用 ClickHouse Cloud 控制台或 API。现在,您可以使用 Terraform 为服务添加或移除副本,从而按需以编程方式对 ClickHouse 服务进行扩缩容。

更多信息,请参阅 ClickHouse Terraform provider。

2024年5月30日

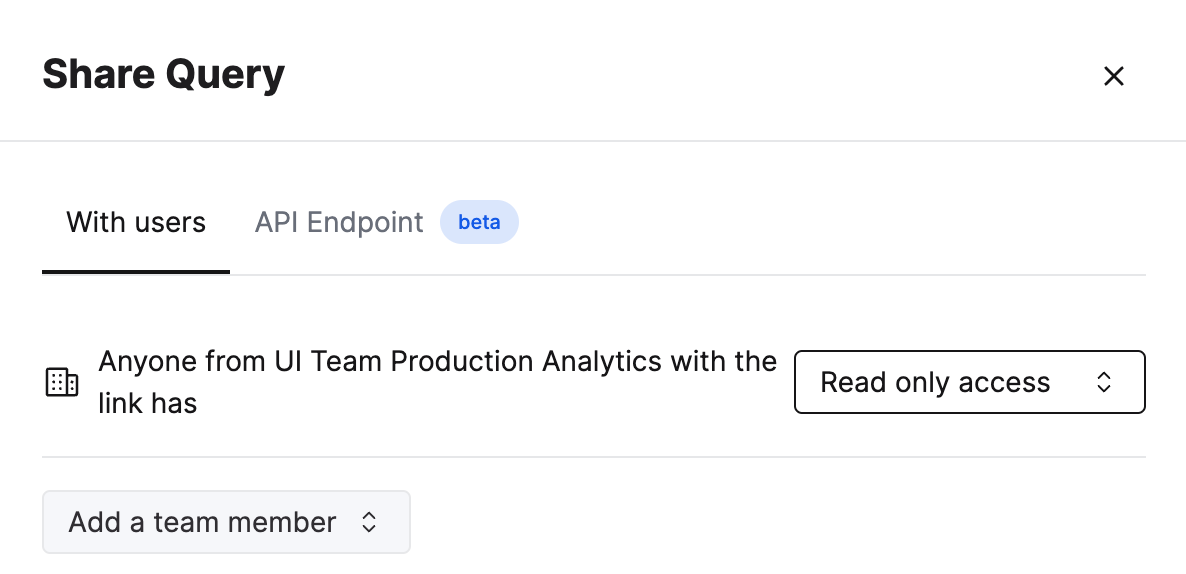

与团队成员共享查询

当您编写 SQL 查询时,团队中的其他人很可能也会觉得这条查询很有用。此前,您只能通过 Slack 或电子邮件发送查询;如果您后来对其进行了修改,团队成员也无法自动收到更新。

我们很高兴地宣布,您现在可以通过 ClickHouse Cloud 控制台轻松共享查询。在查询编辑器中,您可以直接将查询共享给整个团队或特定团队成员。您还可以指定对方是仅具有读取权限,还是仅具有写入权限。点击查询编辑器中的 共享 按钮,试用新的查询共享功能。

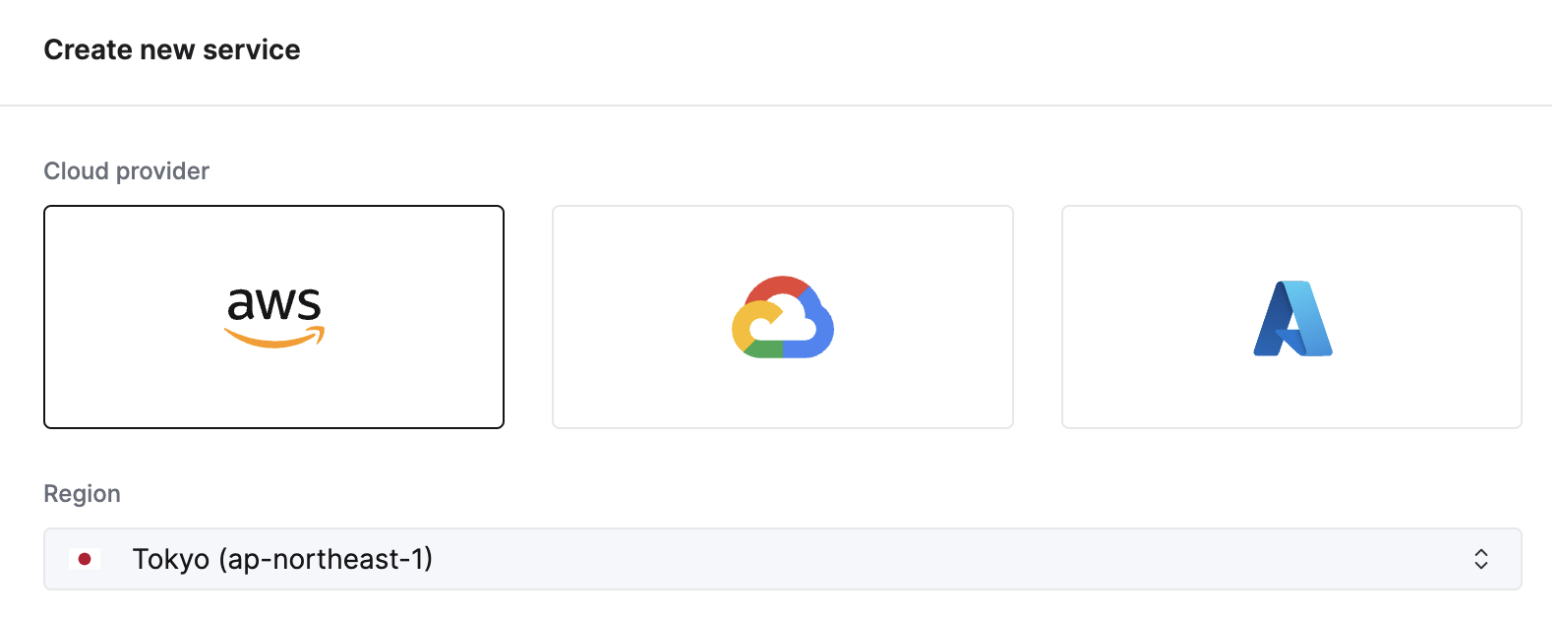

适用于 Microsoft Azure 的 ClickHouse Cloud 现已进入 Beta

我们终于推出了可在 Microsoft Azure 上创建 ClickHouse Cloud 服务的功能。作为私有预览计划的一部分,已有许多客户在生产环境中使用部署在 Azure 上的 ClickHouse Cloud。现在,任何人都可以在 Azure 上创建自己的服务。您在 AWS 和 GCP 上喜爱的所有 ClickHouse 功能,只要 Azure 支持,同样都可以使用。

我们预计将在未来几周内让适用于 Azure 的 ClickHouse Cloud 达到正式可用阶段。阅读这篇博客文章了解更多信息,或通过 ClickHouse Cloud 控制台在 Azure 上创建新的服务。

注意:Azure 目前暂不支持 Development 服务。

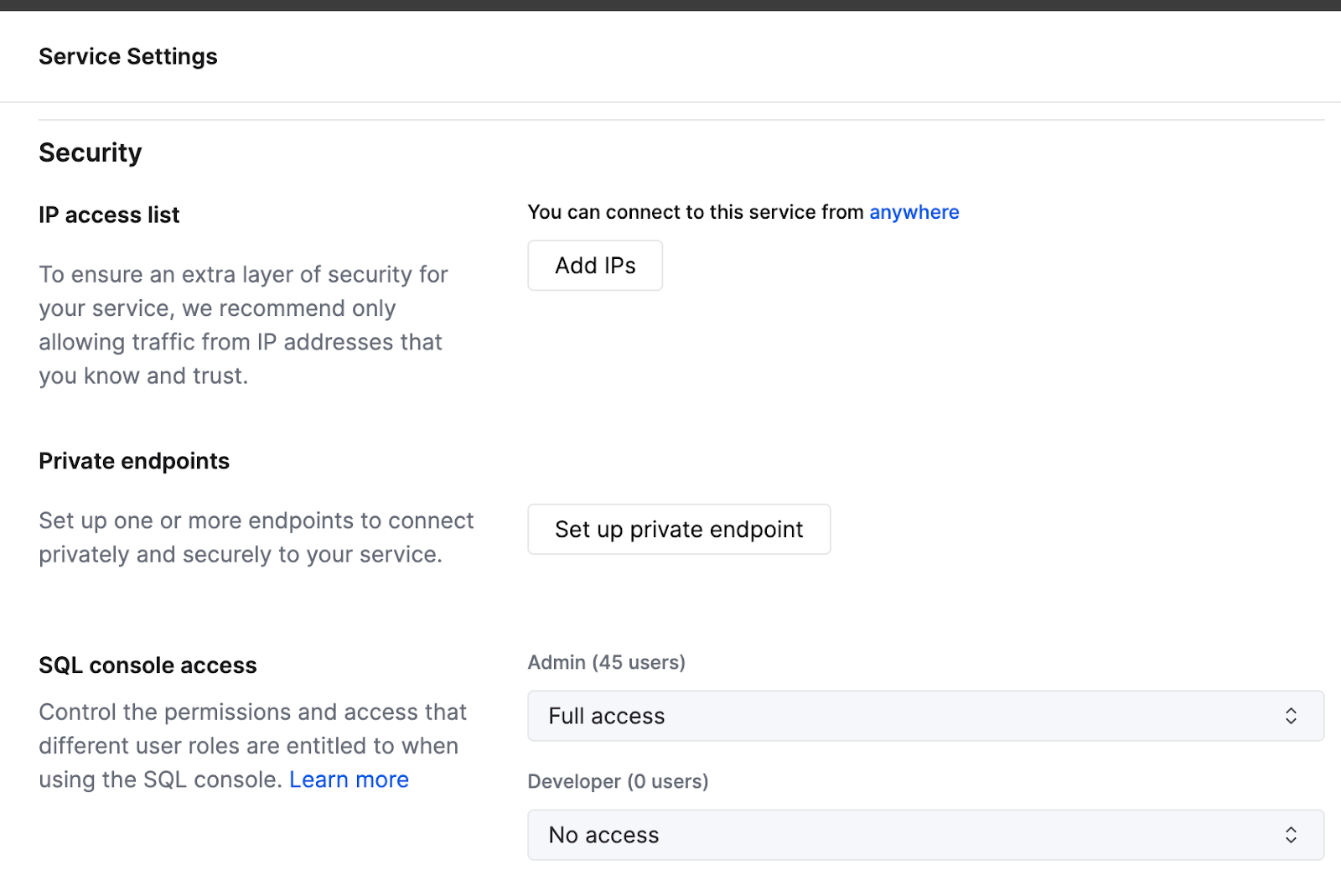

通过 Cloud 控制台设置 Private Link

我们的 Private Link 功能支持将您的 ClickHouse Cloud 服务与云服务商账户中的内部服务连接起来,无需将流量导向公共互联网,从而节省成本并提升安全性。此前,这项功能较难配置,并且需要使用 ClickHouse Cloud API。

现在,您只需点击几下,即可直接在 ClickHouse Cloud 控制台中配置私有端点。只需前往服务的 设置,进入 Security 部分,然后点击 Set up private endpoint。

2024 年 5 月 17 日

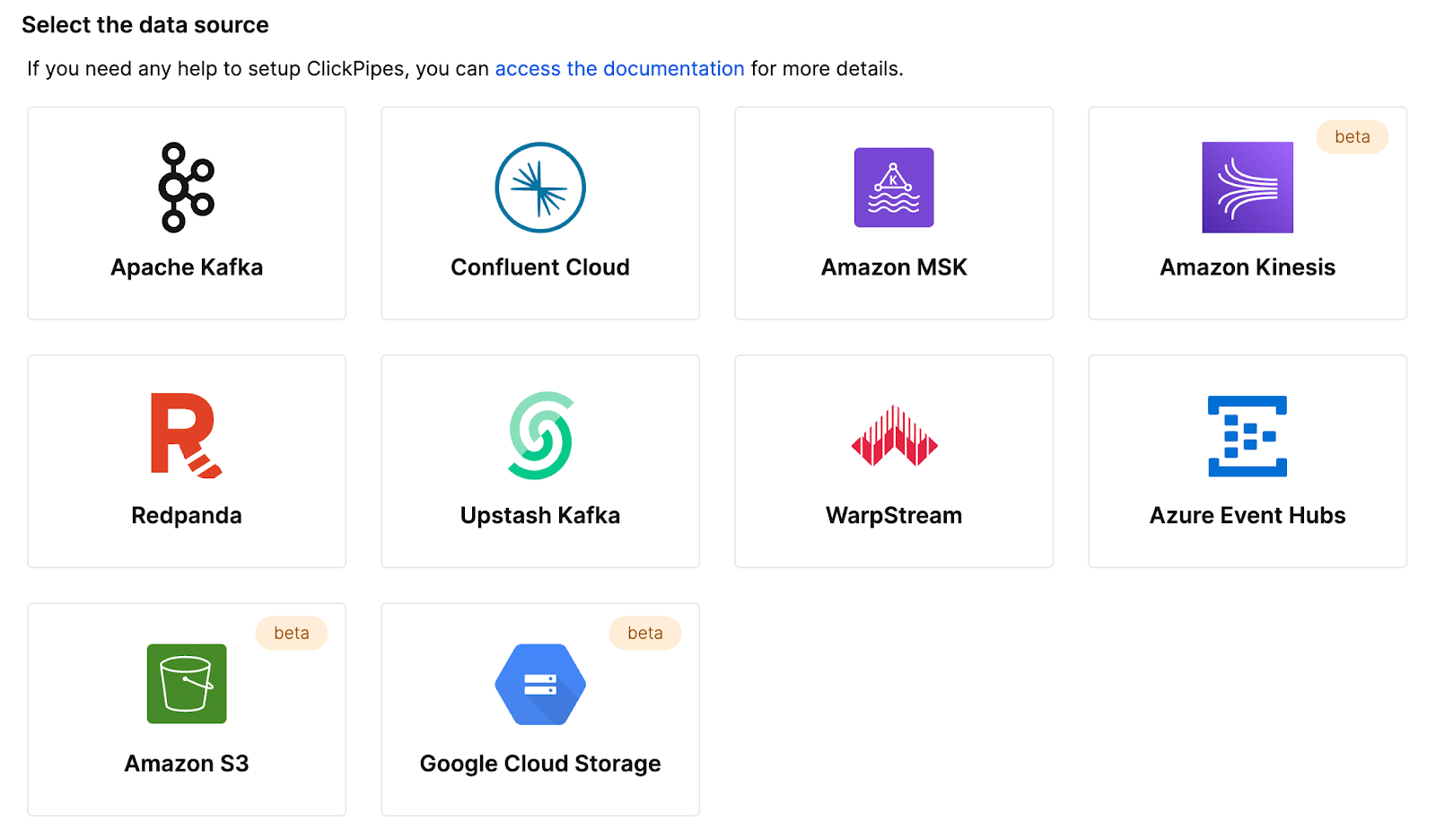

使用 ClickPipes 从 Amazon Kinesis 摄取数据 (Beta)

ClickPipes 是 ClickHouse Cloud 提供的一项专有服务,可让您无需编写代码即可摄取数据。Amazon Kinesis 是 AWS 的全托管流服务,用于摄取并存储数据流以供处理。我们很高兴推出适用于 Amazon Kinesis 的 ClickPipes Beta,这是呼声最高的集成之一。我们希望为 ClickPipes 增加更多集成,因此如果您希望我们支持某个数据源,请告诉我们。有关此功能的更多信息,请参阅此处。

您可以在 Cloud 控制台 中试用 ClickPipes 全新的 Amazon Kinesis 集成:

可配置备份 (私有预览)

备份对于任何数据库都至关重要 (无论其可靠性有多高) ,而自 ClickHouse Cloud 推出之初,我们就一直非常重视备份。本周,我们推出了可配置备份,为服务备份提供了更大的灵活性。您现在可以控制开始时间、保留时长和频率。此功能适用于 Production 和 Dedicated 服务,不适用于 Development 服务。由于该功能目前处于私有预览阶段,如需为您的服务启用此功能,请联系 support@clickhouse.com。有关可配置备份的更多信息,请参阅此处。

根据您的 SQL 查询创建 API (Beta)

当您为 ClickHouse 编写 SQL 查询时,仍然需要通过驱动连接到 ClickHouse,才能让应用程序调用该查询。现在,借助我们的 Query Endpoints 功能,您无需任何配置即可直接通过 API 执行 SQL 查询。您可以指定查询端点返回 JSON、CSV 或 TSV。点击 Cloud Console 中的“共享”按钮,即可使用您的查询试用这项新功能。有关 Query Endpoints 的更多信息,请参阅此处。

官方 ClickHouse 认证现已上线

ClickHouse Develop 培训课程包含 12 个免费培训模块。在本周之前,还没有官方途径可证明您已熟练掌握 ClickHouse。我们最近推出了一项官方考试,通过后即可成为 ClickHouse 认证开发者。完成该考试后,您便可以向当前和未来的雇主展示您在 ClickHouse 相关主题上的掌握程度,包括数据摄取、建模、分析、性能优化等。您可以在这里参加考试,或在这篇博客文章中了解有关 ClickHouse 认证的更多信息。

2024 年 4 月 25 日

使用 ClickPipes 从 S3 和 GCS 加载数据

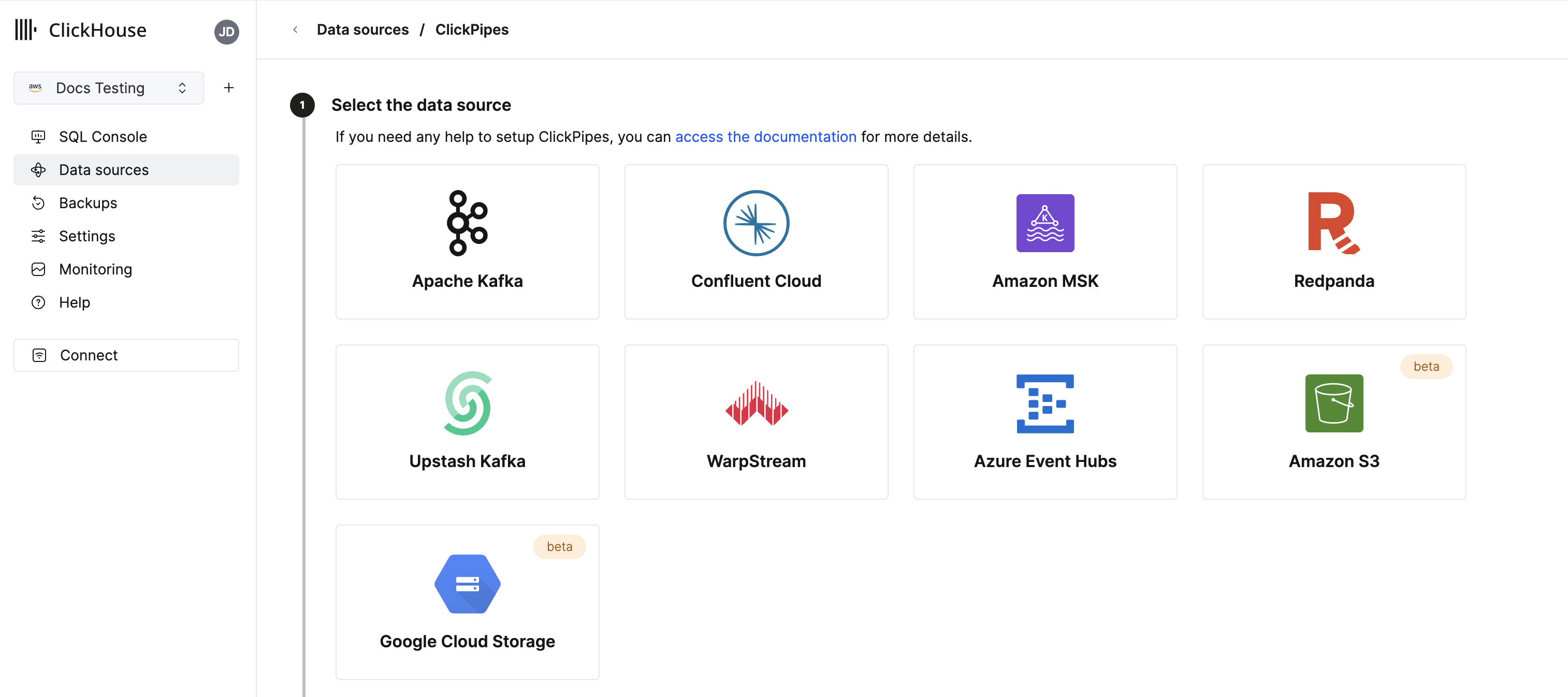

您可能已经注意到,在我们新发布的 Cloud 控制台 中,新增了一个名为“数据源”的部分。“数据源”页面由 ClickPipes 提供支持,这是 ClickHouse Cloud 的一项原生功能,可让您轻松地将来自多种来源的数据导入 ClickHouse Cloud。

ClickPipes 的最新更新支持直接从 Amazon S3 和 Google Cloud Storage 上传数据。虽然您仍然可以使用我们内置的表函数,但 ClickPipes 是一项通过 UI 提供的全托管服务,只需点击几下,您就可以从 S3 和 GCS 摄取数据。该功能目前仍处于私有预览阶段,但您今天就可以通过 Cloud 控制台 试用。

使用 Fivetran 将来自 500 多个数据源的数据加载到 ClickHouse Cloud

ClickHouse 可以快速查询您的所有大型数据集,但前提当然是先将数据写入 ClickHouse。借助 Fivetran 丰富的连接器,您现在可以快速从 500 多个数据源加载数据。无论您需要从 Zendesk、Slack 还是其他常用应用加载数据,Fivetran 全新的 ClickHouse 目标端如今都支持您将 ClickHouse 用作应用数据的目标数据库。

这是一个开源集成,由我们的集成团队经过数月的努力构建而成。您可以在此查看我们的发布博客文章以及 GitHub 代码仓库。

其他变更

控制台变更

- SQL 控制台支持输出格式

集成变更

- ClickPipes Kafka 连接器支持多 Broker 配置

- PowerBI 连接器支持指定 ODBC 驱动配置选项。

2024年4月18日

ClickHouse Cloud 现已支持 AWS 东京区域

此版本为 ClickHouse Cloud 新增了 AWS 东京区域 (ap-northeast-1) 。为了让 ClickHouse 成为速度最快的数据库,我们持续为各个云平台增加更多区域,以尽可能降低延迟。您可以在更新后的 Cloud Console 中创建位于东京区域的新服务。

其他变更:

控制台变更

- ClickPipes for Kafka 现已正式支持 Avro 格式

- 为 Terraform provider 完整实现资源 (服务和私有端点) 导入支持

集成变更

- NodeJS 客户端发布重大稳定版本:增强了对查询和 ResultSet 的 TypeScript 支持,并支持 URL 配置

- Kafka Connector:修复了写入 DLQ 时忽略异常的 bug,新增对 Avro Enum 类型的支持,并发布了在 MSK 和 Confluent Cloud 上使用该连接器的指南

- Grafana:修复了 UI 中对 Nullable 类型的支持,并修复了对动态 OTel tracing 表名的支持

- DBT:修复了自定义 materialization 的模型设置

- Java 客户端:修复了错误代码解析不正确的 bug

- Python 客户端:修复了数值类型的参数绑定,修复了查询绑定中数字列表相关的 bug,并新增了 SQLAlchemy Point 支持

2024 年 4 月 4 日

推出全新的 ClickHouse Cloud 控制台

此版本推出了全新云控制台的私有预览。

在 ClickHouse,我们始终在思考如何改进开发者体验。我们深知,仅仅提供速度最快的实时数据仓库还不够,还必须让它易于使用和管理。

每个月,数千名 ClickHouse Cloud 用户都会在我们的 SQL 控制台中执行数十亿次查询,这也是我们决定进一步投入打造世界一流控制台的原因,让您能够比以往更轻松地与自己的 ClickHouse Cloud 服务交互。全新的Cloud 控制台体验将独立的 SQL 编辑器与管理控制台整合到一个直观的 UI 中。

部分客户将获得全新Cloud 控制台体验的预览——这是一种统一且沉浸式的方式,可用于在 ClickHouse 中探索和管理您的数据。如果您希望获得优先访问权限,请通过 support@clickhouse.com 联系我们。

2024 年 3 月 28 日

此版本新增了对 Microsoft Azure 的支持、通过 API 进行水平扩缩容,以及处于私有预览阶段的发布渠道。

常规更新

- 新增了对 Microsoft Azure 的支持,目前处于私有预览阶段。要获取访问权限,请联系账户管理团队或支持团队,或加入候补名单。

- 推出了发布渠道,可根据环境类型指定升级时机。在此次发布中,我们新增了“fast”发布渠道,使您可以先于生产环境升级非生产环境 (如需启用,请联系支持团队) 。

管理相关变更

- 新增支持通过 API 配置水平扩缩容 (私有预览;如需启用,请联系支持团队)

- 改进自动扩缩容,可在服务启动时因内存不足报错时自动扩容

- 新增支持通过 Terraform provider 为 AWS 配置 CMEK

控制台变更

- 新增了对 Microsoft 社交登录的支持

- SQL 控制台现已支持参数化查询共享

- 查询编辑器性能显著提升 (在部分欧洲区域,延迟从 5 秒降至 1.5 秒)

集成变更

- ClickHouse OpenTelemetry exporter:新增对 ClickHouse 复制表引擎的支持,并新增了集成测试

- ClickHouse DBT adapter:新增对字典 materialization 宏的支持,以及生存时间 (TTL) 表达式支持的测试

- ClickHouse Kafka Connect Sink:新增了与 Kafka 插件发现机制的兼容性 (社区贡献)

- ClickHouse Java 客户端:为新的客户端 API 引入了一个新包,并为 Cloud 测试增加了测试覆盖

- ClickHouse NodeJS 客户端:扩展了针对新版 HTTP keep-alive 行为的测试和文档。自 v0.3.0 版本起可用

- ClickHouse Golang 客户端:修复了将 Enum 用作 Map 键时的一个 bug;修复了错误连接留在连接池中时的一个 bug (社区贡献)

- ClickHouse Python 客户端:新增支持 通过 PyArrow 流式传输查询结果 (社区贡献)

安全更新

- 已更新 ClickHouse Cloud,以防止在启用查询缓存时绕过"基于角色的访问控制" (CVE-2024-22412)

2024 年 3 月 14 日

此版本提供了多项抢先体验功能,包括全新的 Cloud 控制台 体验、支持从 S3 和 GCS 批量加载的 ClickPipes,以及 ClickPipes 对 Kafka 中 Avro 格式的支持。该版本还将 ClickHouse 数据库升级至 24.1,新增了对新函数的支持,并在性能和资源使用方面进行了优化。

控制台变更

- 全新的 Cloud 控制台体验现已开放早期试用 (如果您有兴趣参与,请联系支持团队) 。

- 用于从 S3 和 GCS 批量加载的 ClickPipes 现已开放早期试用 (如果您有兴趣参与,请联系支持团队) 。

- ClickPipes for Kafka 现已在早期试用中支持 Avro 格式 (如果您有兴趣参与,请联系支持团队) 。

ClickHouse 版本升级

- 针对 FINAL 的优化、向量化改进以及更快的聚合——详情请参见 23.12 发布博客。

- 新增了用于处理 punycode、字符串相似性和异常值检测的函数,以及针对合并操作和 Keeper 的内存优化——详情请参见 24.1 发布博客 和 演示文稿。

- 此 ClickHouse Cloud 版本基于 24.1,包含数十项新功能、性能改进和错误修复。详情请参见核心数据库的 变更日志。

集成变更

- Grafana:修复了 v4 仪表板迁移和临时筛选逻辑问题

- Tableau Connector:修复了 DATENAME 函数以及对 "real" 参数的舍入问题

- Kafka Connector:修复了连接初始化中的 NPE,并新增了指定 JDBC 驱动选项的能力

- Golang 客户端:降低了处理响应时的内存占用,修复了 Date32 的极值问题,以及启用压缩时错误报告的问题

- Python 客户端:改进了 datetime 参数的时区支持,并提升了 Pandas DataFrame 的性能

2024 年 2 月 29 日

此次发布缩短了 SQL 控制台应用程序的加载时间,新增了 ClickPipes 对 SCRAM-SHA-256 身份验证的支持,并将对嵌套结构的支持扩展到 Kafka Connect。

控制台变更

- 优化了 SQL 控制台应用的初始加载时间

- 修复了 SQL 控制台中的竞争条件问题,该问题会导致出现“身份验证失败”错误

- 修复了监控页面上的一个问题:最近一次内存分配值有时显示不正确

- 修复了 SQL 控制台有时会发出重复的 KILL QUERY 命令的问题

- 为 ClickPipes 中基于 Kafka 的数据源添加了对 SCRAM-SHA-256 身份验证方法的支持

集成变更

- Kafka Connector:扩展了对复杂嵌套结构 (Array、Map) 的支持;新增了对 FixedString 类型的支持;新增了将数据摄取到多个数据库的支持

- Metabase:修复了与 23.8 版本以下 ClickHouse 的兼容性问题

- DBT:新增了在创建模型时传递设置的功能

- Node.js 客户端:新增了对长时间运行查询 (>1hr) 的支持,并可妥善处理空值

2024 年 2 月 15 日

此版本升级了核心数据库版本,新增了通过 Terraform 配置 Private Link 的能力,并支持通过 Kafka Connect 为非同期 INSERT 实现精确一次语义。

ClickHouse 版本升级

- 用于从 S3 持续、定期加载数据的 S3Queue 表引擎已可在生产环境中使用 - 详情请参阅 23.11 发布博客。

- FINAL 的性能显著提升,同时对 SIMD 指令的向量化进行了改进,从而加快了查询速度 - 详情请参阅 23.12 发布博客。

- 此 ClickHouse Cloud 版本基于 23.12,包含数十项新功能、性能改进和错误修复。详情请参阅核心数据库变更日志。

控制台变更

- 新增通过 Terraform provider 配置 AWS Private Link 和 GCP Private Service Connect 的功能

- 提升了远程文件数据导入的可靠性

- 为所有数据导入新增了导入状态详情弹出面板

- 为 S3 数据导入新增了 key/secret key 凭证支持

集成变更

- Kafka Connect

- 支持用于恰好一次语义的

async_insert(默认禁用)

- 支持用于恰好一次语义的

- Golang 客户端

- 修复了 DateTime 绑定问题

- 提升了批次插入性能

- Java 客户端

- 修复了请求压缩问题

设置变更

use_mysql_types_in_show_columns不再需要。在通过 MySQL 接口连接时,它会自动启用。async_insert_max_data_size的默认值现为10 MiB

2024年2月2日

此版本现已提供适用于 Azure Event Hub 的 ClickPipes,并借助 v4 ClickHouse Grafana 连接器大幅改进了日志和链路追踪的导航流程,同时新增了对 Flyway 和 Atlas 数据库 schema 管理工具的支持。

控制台变更

- 新增 ClickPipes 对 Azure Event Hub 的支持

- 新创建的服务默认空闲时间为 15 分钟

集成变更

- ClickHouse Grafana 用数据源 发布 v4 版本

- 全面重构了查询构建器,为表格、日志、时间序列和链路追踪提供专用编辑器

- 全面重构了 SQL 生成器,以支持更复杂、动态的查询

- 在日志和链路追踪视图中新增了对 OpenTelemetry 的原生支持

- 扩展了配置选项,允许为日志和链路追踪指定默认表和列

- 新增了指定自定义 HTTP 请求头的功能

- 以及更多改进——请查看完整的变更日志

- 数据库 schema 管理工具

- Kafka Connector Sink

- 优化了向带默认值的表摄取数据的过程

- 新增了对 DateTime64 中字符串形式日期的支持

- Metabase

- 新增了对多数据库连接的支持

2024 年 1 月 18 日

此版本新增了 AWS 区域 (伦敦 / eu-west-2) ,为 Redpanda、Upstash 和 Warpstream 增加了 ClickPipes 支持,并提升了核心数据库能力 is_deleted 的可靠性。

常规变更

- 新增 AWS 区域:伦敦 (eu-west-2)

控制台变更

- 新增了对 Redpanda、Upstash 和 Warpstream 的 ClickPipes 支持

- 现可在 UI 中配置 ClickPipes 的身份验证机制

集成变更

- Java 客户端:

- 破坏性变更:移除了在调用中指定随机 URL 句柄的能力。该功能已从 ClickHouse 中移除

- 弃用项:Java CLI 客户端和 GRPC 包

- 新增对 RowBinaryWithDefaults 格式的支持,以减小批次大小并降低 ClickHouse 实例负载 (由 Exabeam 提出)

- 使 Date32 和 DateTime64 的范围边界与 ClickHouse 兼容,并改进了对 Spark Array 字符串类型和节点选择机制的兼容性

- Kafka Connector:新增了一个 Grafana 用 JMX 监控仪表板

- PowerBI:ODBC 驱动程序设置现可在 UI 中配置

- JavaScript 客户端:提供了查询摘要信息,支持在插入时指定特定列的子集,并支持为 Web 客户端配置 keep_alive

- Python 客户端:为 SQLAlchemy 新增了 Nothing 类型支持

可靠性变更

- 面向用户的非向后兼容变更:此前,两个功能 (is_deleted 和

OPTIMIZE CLEANUP) 在特定条件下可能导致 ClickHouse 中的数据损坏。为保护用户数据完整性,同时保留该功能的核心能力,我们调整了这一功能的工作方式。具体来说,MergeTree 设置clean_deleted_rows现已弃用,且不再生效。默认情况下,不允许使用CLEANUP关键字 (如需使用,您需要启用allow_experimental_replacing_merge_with_cleanup) 。如果您决定使用CLEANUP,则需要确保它始终与FINAL一同使用,并且必须保证在运行 ``OPTIMIZE FINAL CLEANUP``` 后,不会再插入旧版本的行。