ClickHouse Cloud

この機能は ClickHouse Cloud のプライベートプレビュー中です。組織として優先的なアクセスに関心がある場合は、 ウェイトリストに登録してください。

ClickHouse Cloud を初めて利用する場合は、 こちら をクリックして詳細を確認するか、無料トライアルにサインアップして開始してください。

このオプションは、ClickHouse Cloud を利用しているユーザー向けに設計されています。このデプロイメントパターンでは、ClickHouse と HyperDX の両方が ClickHouse Cloud 上にホストされるため、ユーザーがセルフホストする必要のあるコンポーネント数を最小限に抑えられます。

インフラ管理の負荷を軽減できるだけでなく、このデプロイメントパターンでは認証が ClickHouse Cloud の SSO/SAML と統合されます。セルフホスト型デプロイメントと異なり、ダッシュボード、保存済み検索、ユーザー設定、アラートなどのアプリケーション状態を保存するための MongoDB インスタンスを用意する必要もありません。

このモードでは、データのインジェストは完全にユーザーに委ねられます。独自にホストした OpenTelemetry コレクター、クライアントライブラリからの直接インジェスト、Kafka や S3 などの ClickHouse ネイティブなテーブルエンジン、ETL パイプライン、あるいは ClickHouse Cloud のマネージドインジェストサービスである ClickPipes を使用して、ClickHouse Cloud にデータを取り込むことができます。このアプローチは、ClickStack を運用するうえで最もシンプルかつ高パフォーマンスな方法を提供します。

適したユースケース

このデプロイメントパターンは、次のようなシナリオに最適です。

- すでに ClickHouse Cloud にオブザーバビリティデータがあり、それを HyperDX を使って可視化したい場合。

- 大規模なオブザーバビリティデプロイメントを運用しており、ClickHouse Cloud と組み合わせた ClickStack の専用のパフォーマンスとスケーラビリティが必要な場合。

- すでに分析用途で ClickHouse Cloud を利用していて、ClickStack のインストルメンテーションライブラリを使ってアプリケーションを計測し、同じクラスターにデータを送信したい場合。この場合は、オブザーバビリティワークロード用のコンピュートリソースを分離するために warehouses の利用を推奨します。

デプロイ手順

このガイドでは、すでに ClickHouse Cloud サービスが作成済みであることを前提とします。まだサービスを作成していない場合は、クイックスタートガイドの「ClickHouse サービスを作成する」の手順に従ってください。

サービス認証情報のコピー(オプション)

サービスで可視化する既存のオブザーバビリティイベントが既にある場合は、この手順をスキップできます。

メインのサービス一覧に移動し、HyperDXで可視化するオブザーバビリティイベントを収集するサービスを選択してください。

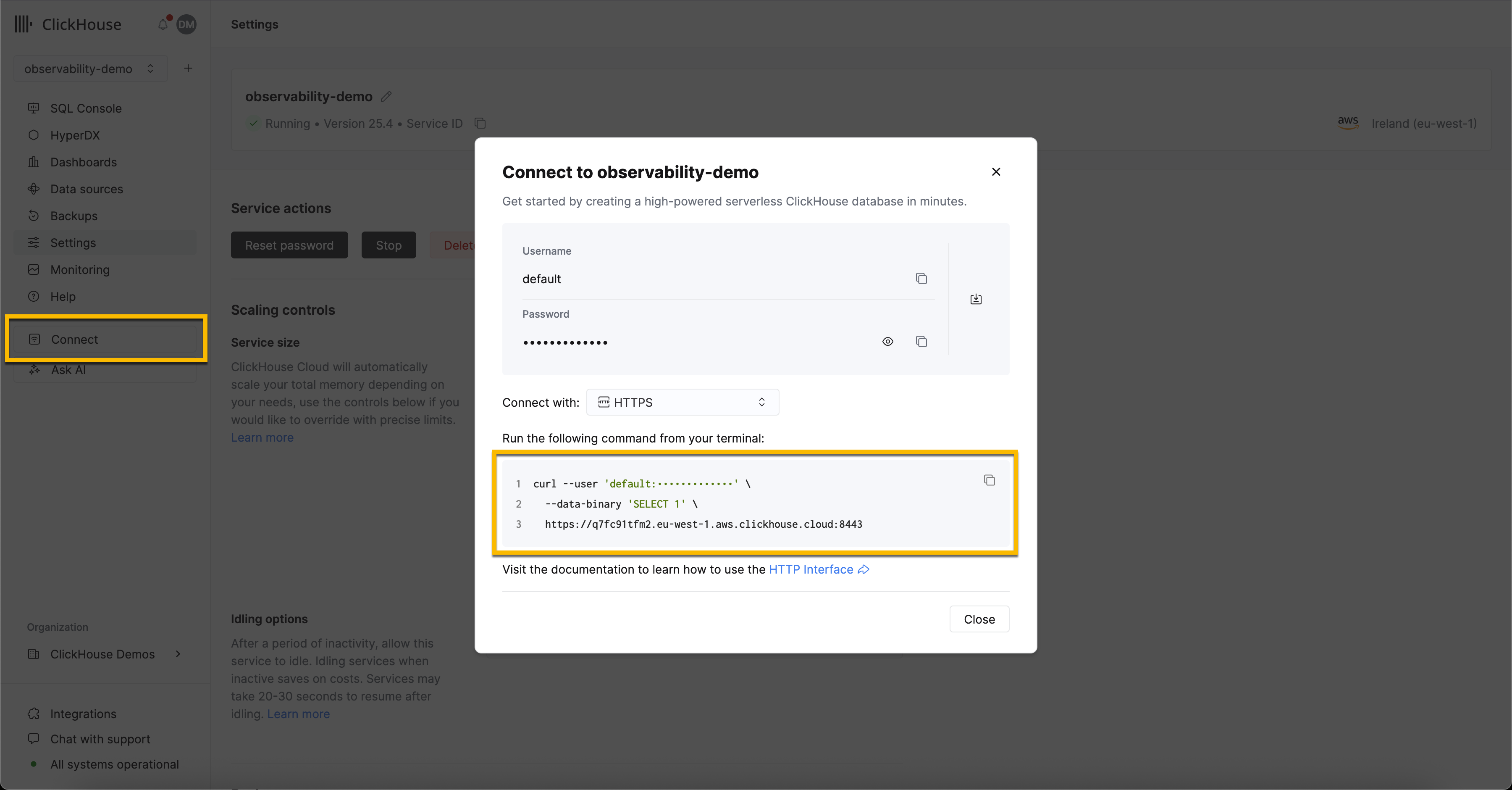

ナビゲーションメニューからConnectボタンをクリックします。モーダルが開き、サービスの認証情報と、各種インターフェースおよび言語による接続手順が表示されます。ドロップダウンからHTTPSを選択し、接続エンドポイントと認証情報を控えてください。

OpenTelemetry Collectorのデプロイ(オプション)

サービスで可視化する既存のオブザーバビリティイベントが既にある場合は、この手順をスキップできます。

このステップでは、OpenTelemetry (OTel) スキーマでテーブルを作成し、HyperDXでデータソースをシームレスに作成できるようにします。また、サンプルデータセットの読み込みやOTelイベントのClickStackへの送信に使用できるOLTPエンドポイントも提供します。

以下の手順では、ClickStackディストリビューションではなく、OTel collectorの標準ディストリビューションを使用します。ClickStackディストリビューションは設定にOpAMPサーバーが必要ですが、現在プライベートプレビューではサポートされていません。以下の設定は、ClickStackディストリビューションのcollectorで使用されているバージョンを再現し、イベント送信用のOTLPエンドポイントを提供します。

OTel collectorの設定をダウンロードします:

otel-cloud-config.yaml

以下のDockerコマンドを使用してコレクターをデプロイします。事前に記録した接続設定を各環境変数に設定し、オペレーティングシステムに応じて適切なコマンドを使用してください。

本番環境では、インジェスト専用のユーザーを作成し、必要なデータベースとテーブルへのアクセス権限を制限することを推奨します。詳細については、"データベースとインジェストユーザー"を参照してください。

HyperDXに接続する

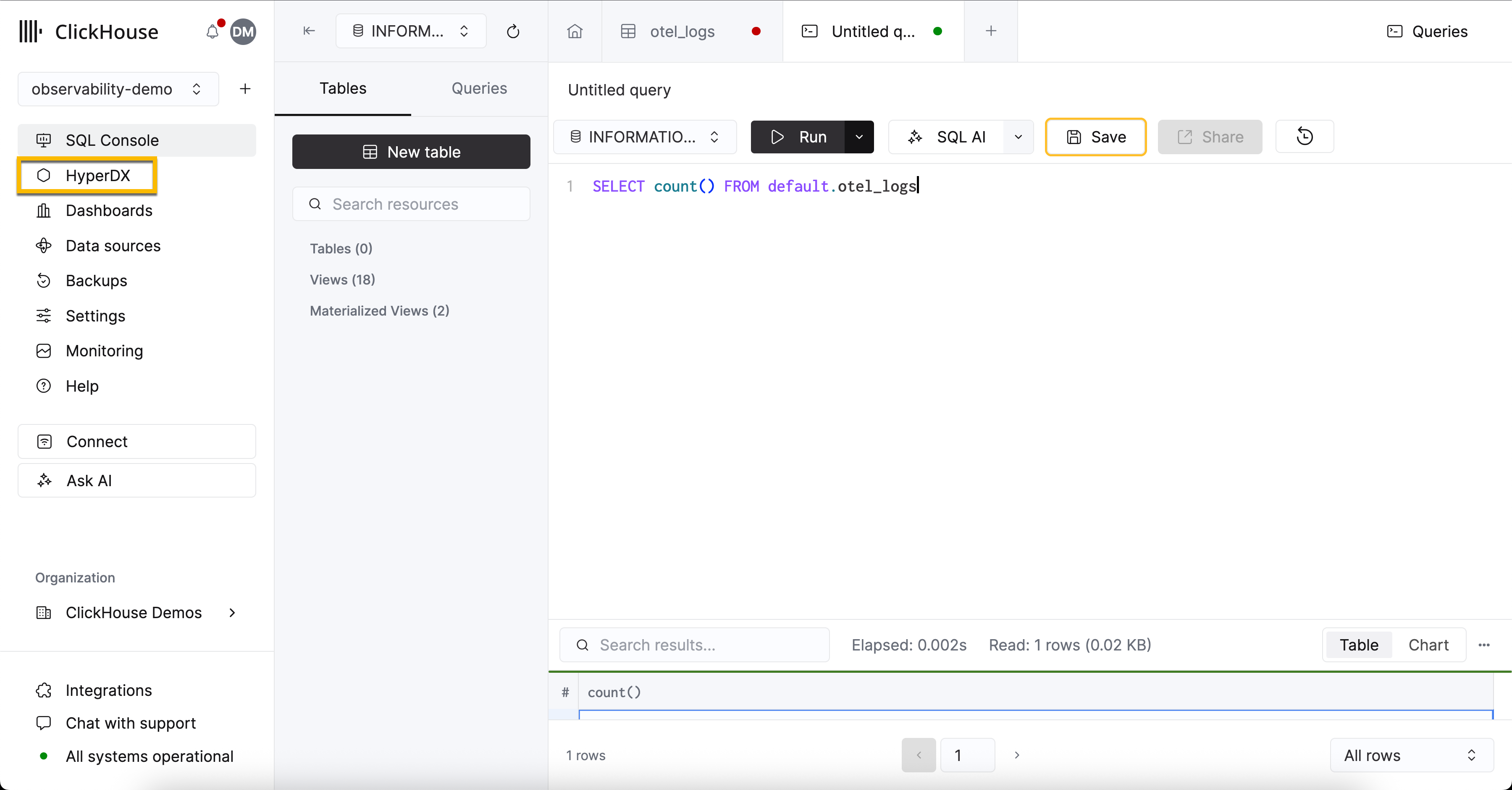

サービスを選択し、左側のメニューから HyperDX を選択します。

ユーザーを作成する必要はなく、自動的に認証されてから、データソースの作成を求められます。

HyperDXインターフェースの操作のみを確認したいユーザーには、OTelデータを使用したサンプルデータセットの利用を推奨します。

ユーザー権限

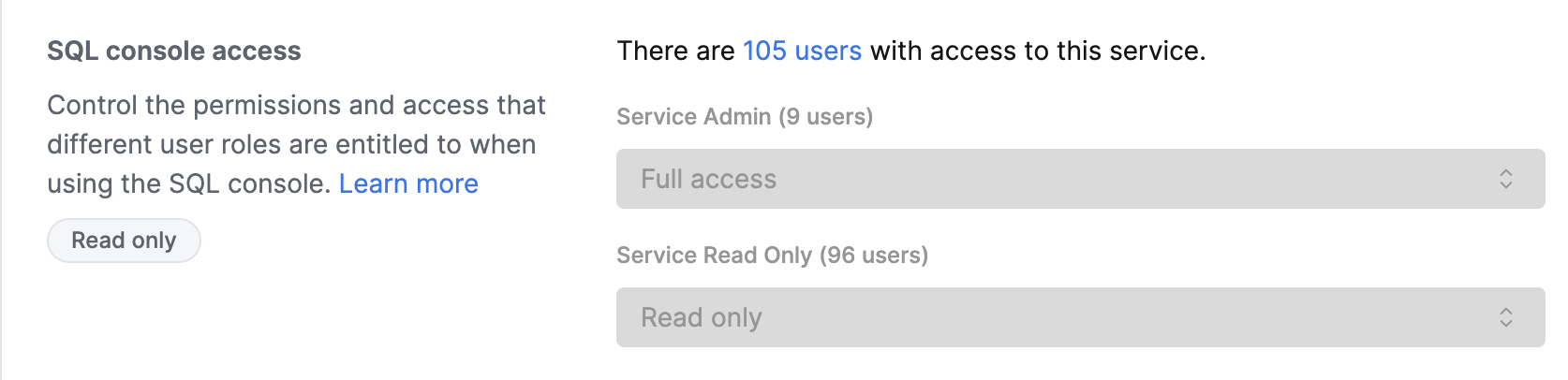

HyperDXにアクセスするユーザーは、ClickHouse Cloudコンソールの認証情報を使用して自動的に認証されます。アクセス制御は、サービス設定で構成されたSQLコンソールの権限を通じて行われます。

ユーザーアクセスの設定

- ClickHouse Cloud コンソールで対象のサービスに移動します

- Settings → SQL Console Access に移動します。

- 各ユーザーごとに適切な権限レベルを設定します。

- Service Admin → Full Access - アラート機能を有効化するために必要

- Service Read Only → Read Only - オブザーバビリティデータの閲覧およびダッシュボードの作成が可能

- No access - HyperDX にアクセスできない

アラートを有効にするには、Service Admin権限(SQL Console AccessドロップダウンのFull Accessに対応)を持つユーザーが少なくとも1名、HyperDXに一度ログインする必要があります。これにより、アラートクエリを実行する専用ユーザーがデータベースにプロビジョニングされます。

データソースを作成する

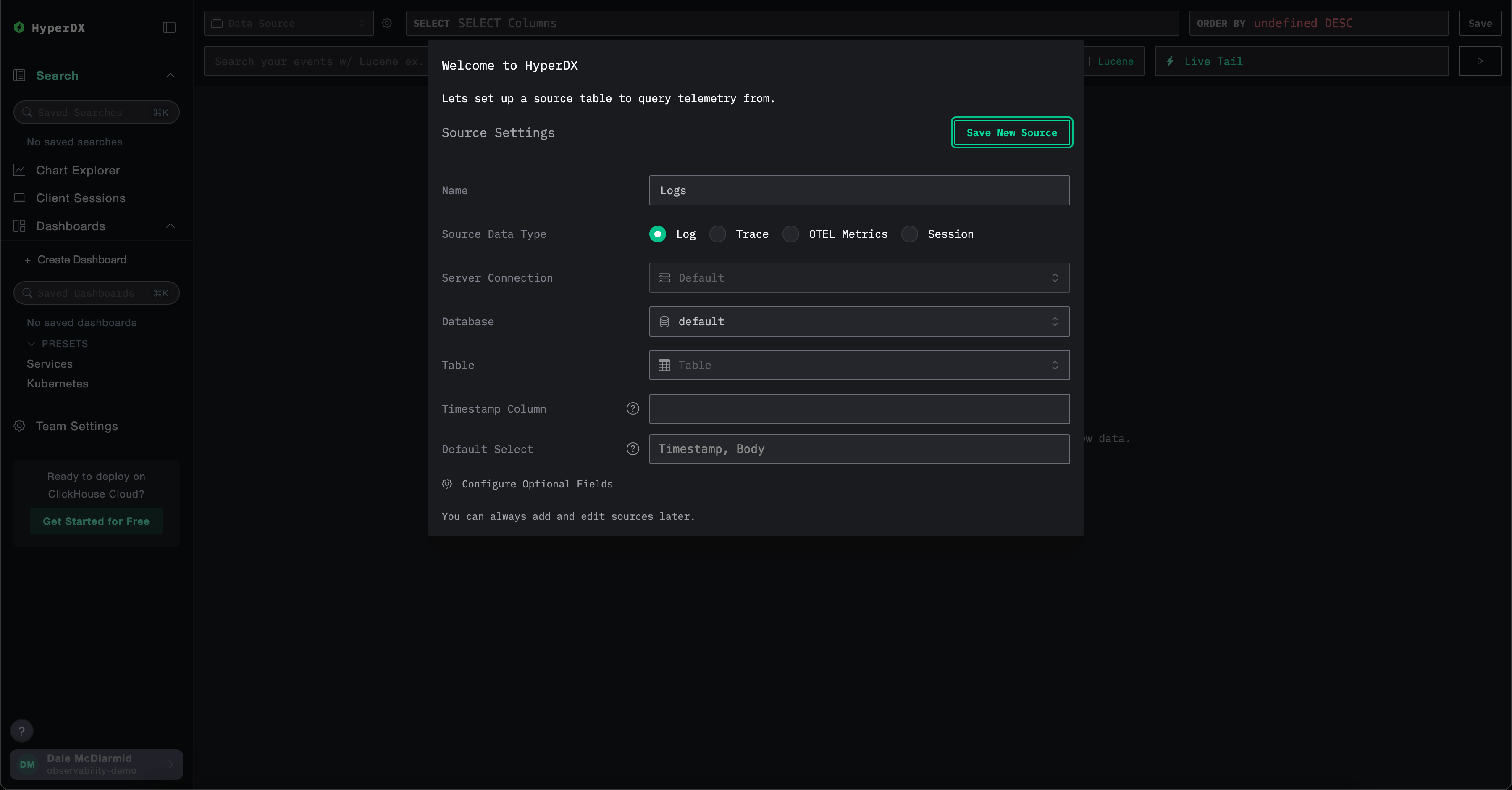

HyperDXはOpenTelemetryネイティブですが、OpenTelemetry専用ではありません。必要に応じて独自のテーブルスキーマを使用することも可能です。

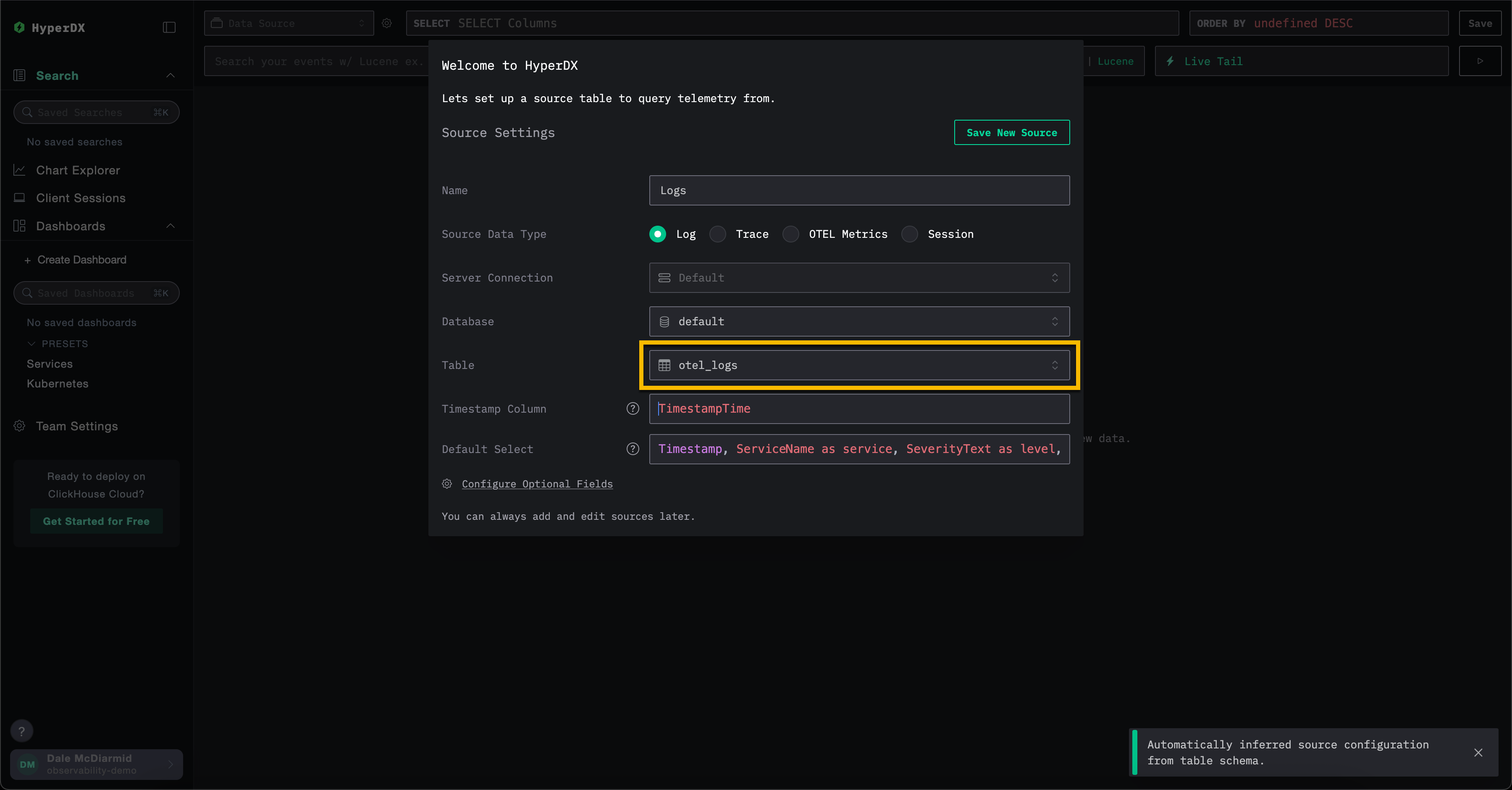

OpenTelemetryスキーマの使用

上記のOTel collectorを使用してClickHouse内にデータベースとテーブルを作成する場合、ソース作成モデル内のすべてのデフォルト値を保持し、Tableフィールドにotel_logsを入力してログソースを作成します。その他の設定はすべて自動検出されるため、Save New Sourceをクリックしてください。

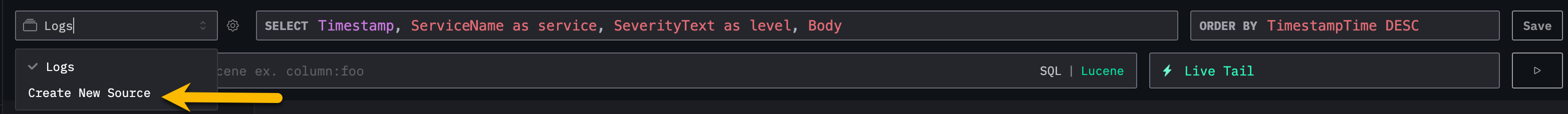

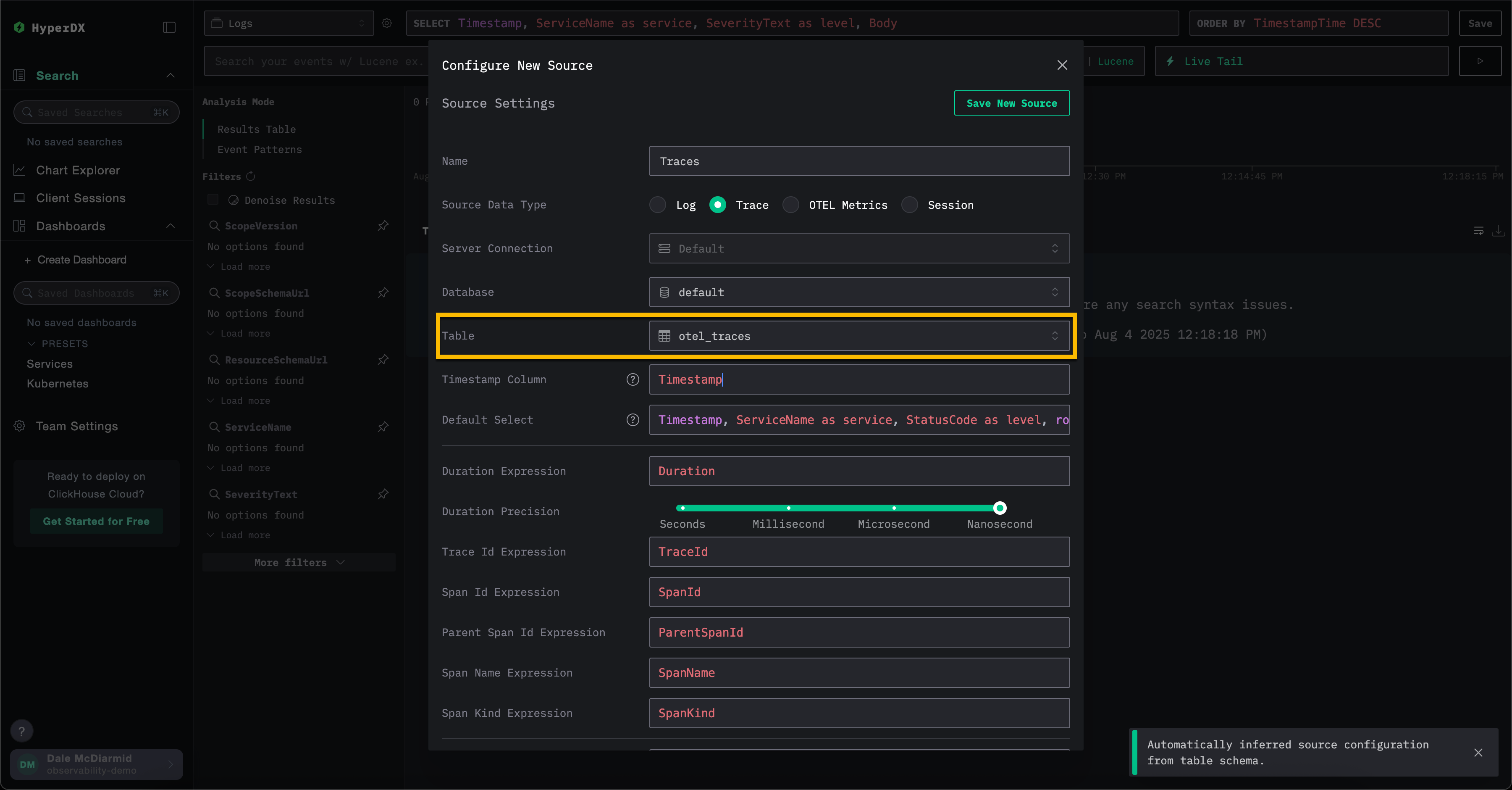

トレースおよびOTelメトリクスのソースを作成するには、トップメニューから新しいソースを作成を選択してください。

ここから、必要なソースタイプを選択し、次に適切なテーブルを選択します。例えば、トレースの場合は otel_traces テーブルを選択してください。すべての設定は自動的に検出されます。

ClickStackでは、ログやトレースなどの異なるデータソースを相互に相関付けることができます。これを有効にするには、各ソースで追加の設定が必要です。例えば、ログソースで対応するトレースソースを指定でき、トレースソースでも同様です。詳細については、"相関ソース"を参照してください。

カスタムスキーマの使用

既存のデータを持つサービスにHyperDXを接続する場合は、必要に応じてデータベースとテーブルの設定を行ってください。テーブルがClickHouse用のOpenTelemetryスキーマに準拠している場合、設定は自動的に検出されます。

独自のスキーマを使用する場合は、必須フィールドが指定されていることを確認したログソースを作成することを推奨します。詳細については、"ログソースの設定"を参照してください。

JSON 型サポート

ClickStack における JSON 型サポートは ベータ機能 です。JSON 型自体は ClickHouse 25.3+ では本番環境向けとして利用可能ですが、ClickStack との統合はまだ積極的に開発中であり、制限があったり、将来的に変更されたり、不具合を含む可能性があります。

ClickStack では、バージョン 2.0.4 以降で JSON 型 をベータ機能としてサポートしています。

この型の利点については JSON 型の利点 を参照してください。

JSON 型のサポートを有効にするには、以下の環境変数を設定する必要があります。

OTEL_AGENT_FEATURE_GATE_ARG='--feature-gates=clickhouse.json'- OTel collector でのサポートを有効にし、スキーマが JSON 型を使用して作成されるようにします。BETA_CH_OTEL_JSON_SCHEMA_ENABLED=true- HyperDX アプリケーションでのサポートを有効にし、JSON データに対してクエリを実行できるようにします。

さらに、JSON が利用中の ClickHouse Cloud サービスで有効になっているか確認するため、[email protected] までお問い合わせください。